ڈیجیٹل FTE بنانا: 4 گھنٹے کا مختصر عملی کورس

15 تصورات، 80% کا حقیقی استعمال کریں - skills، نظام کا Record، اور MCP

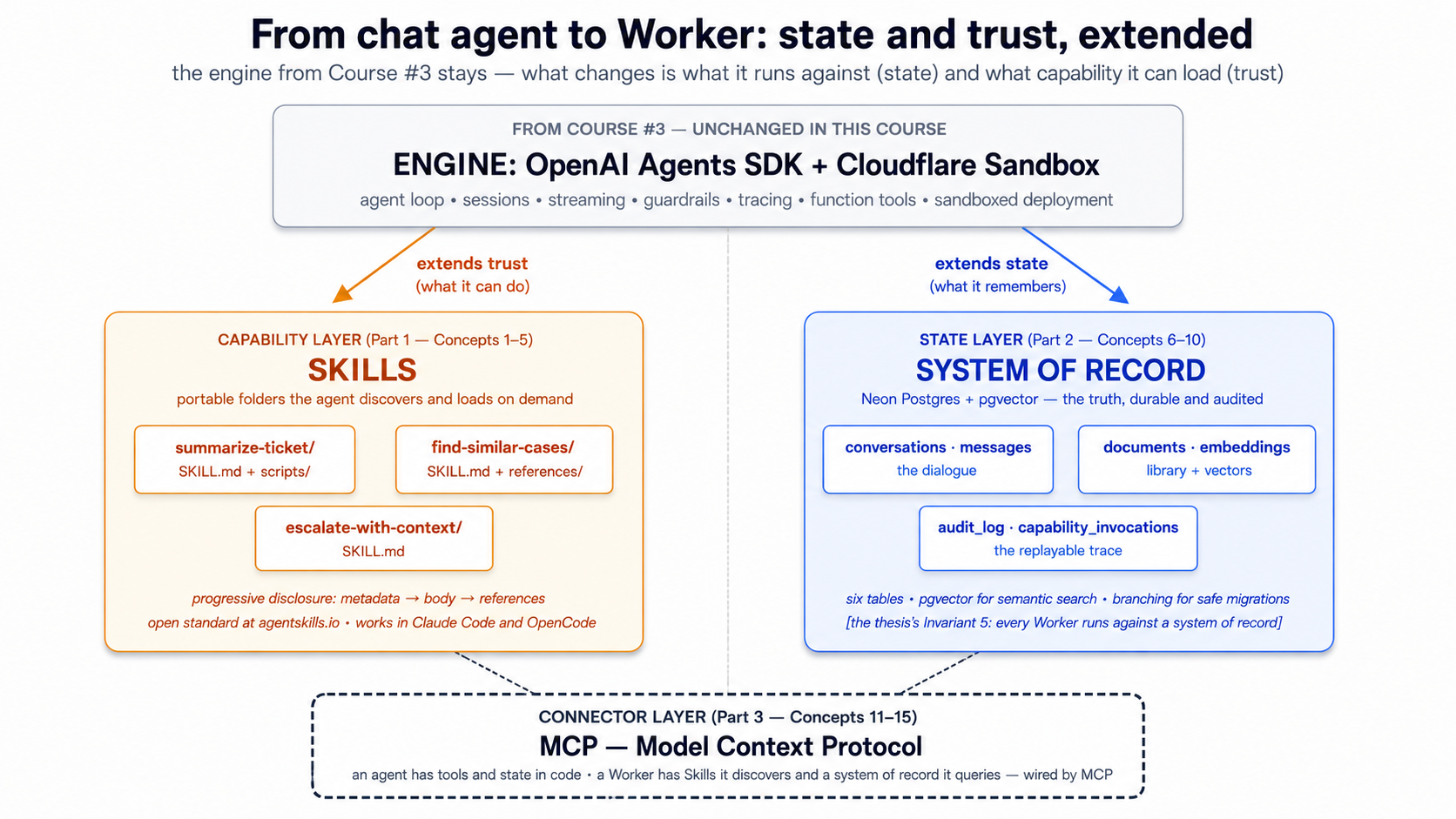

ایک continuation مختصر عملی کورس. یہ ہے کورس #4 میں agentic-coding track. previous کورس، تعمیر AI Agents کے ساتھ OpenAI Agents SDK اور Cloudflare سینڈ باکس، taught آپ کو تعمیر کریں ایک سٹریمنگ chat agent کے ساتھ سیشنز، حفاظتی حدود، اور ایک سینڈ باکسڈ ڈیپلائمنٹ. کے ذریعے end کا that کورس آپ had ایک agent کہ worked. کے ذریعے end کا this کورس آپ'll رکھتے ہیں ایک ورکر: وہی OpenAI Agents SDK foundation، وہی Cloudflare سینڈ باکس runtime، مگر کے ساتھ three additions کہ تبدیلی کیا agent is: portable skills یہ loads on demand، ایک Neon Postgres ریکارڈ کا مستند نظام یہ reads سے اور writes کو، اور ماڈل سیاق و سباق پروٹوکول connections کہ رابطہ دو together.

single insight کہ بناتا ہے everything else click: بدلنا ایک agent میں ایک ورکر ہے دو ڈھانچے سے متعلق فیصلے، کہاں اس کا صلاحیتیں live، اور کہاں اس کا truth lives. skills جواب پہلا. MCP-connected ریکارڈ کے مستند نظام جواب second. Everything میں یہ مختصر عملی کورس ہے ایک کا those دو جوابات یا wiring درمیان انہیں.

میں plain English: ایک chat agent کہ lives میں ایک single Python عمل has اس کا صلاحیتیں baked میں کوڈ اور اس کا memory baked میں RAM. Restart عمل اور دونوں disappear. ایک ورکر ( ڈھانچے سے متعلق اصطلاح our thesis استعمال کرتا ہے کے لیے ایک agent کہ operates اندر ایک کمپنی) has اس کا صلاحیتیں packaged بطور skills (portable فولڈرز agent discovers on demand) اور اس کا memory packaged میں ایک ریکارڈ کا مستند نظام (ایک پائیدار ڈیٹا بیس agent reads سے اور writes کو کے ذریعے ماڈل سیاق و سباق پروٹوکول). previous کورس built engine. یہ کورس builds کیا engine چلتا ہے کے خلاف.

شروع کریں یہاں: ڈھانچے سے متعلق placement اور 15-concept cheat sheet

کہاں یہ کورس sits میں ڈھانچہ. ایجنٹ فیکٹری thesis describes Seven Invariants کہ any پروڈکشن agent نظام لازمی satisfy. Course #3 covered engine layer (Invariant 4): OpenAI Agents SDK بطور harness، Cloudflare سینڈ باکس بطور compute. یہ کورس covers دو زیادہ invariants اور ایک کا پروڈکشن engine کا three pillars:

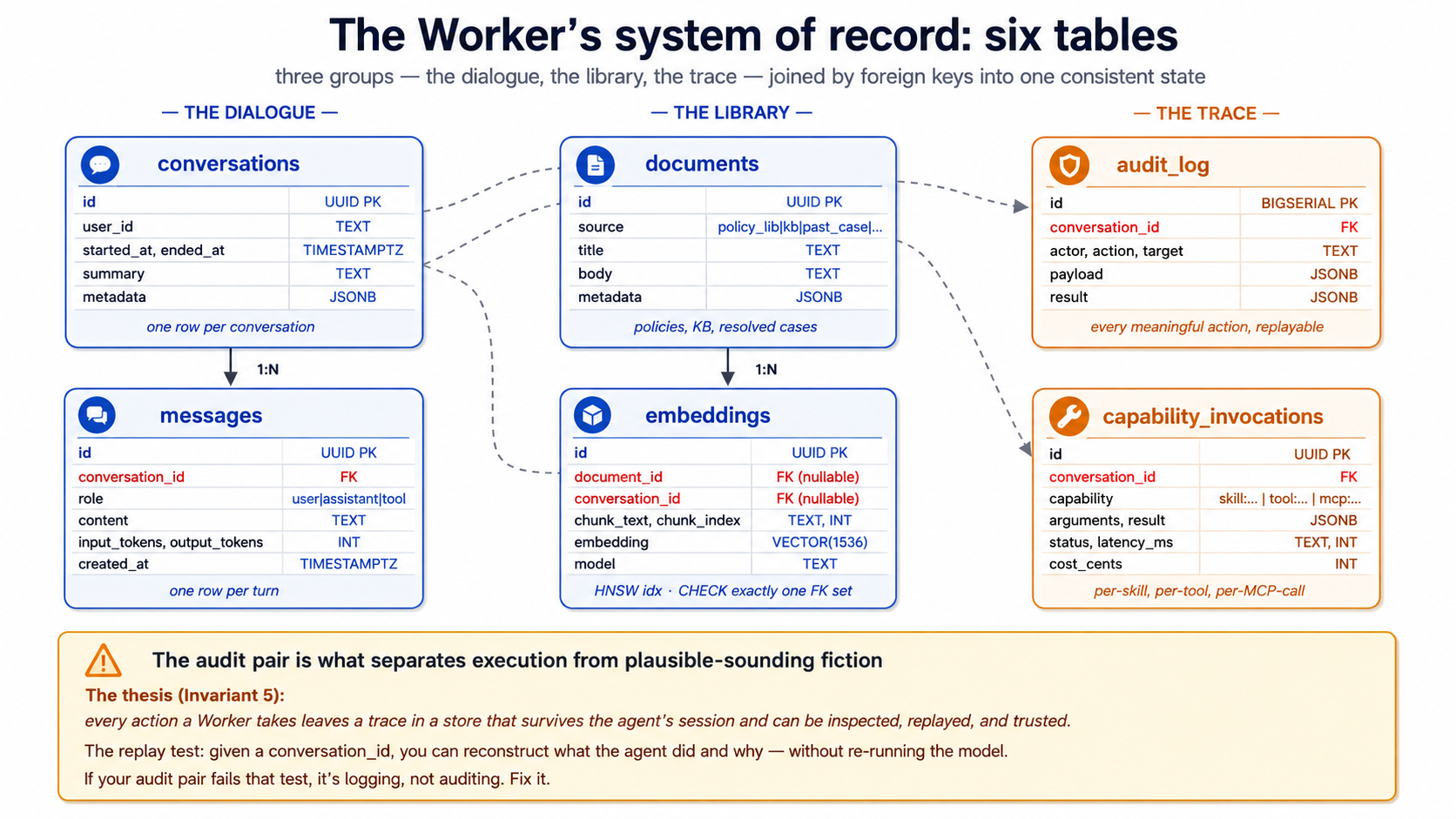

- Invariant 5: ہر ورکر چلتا ہے کے خلاف ایک ریکارڈ کا مستند نظام. "Engine ہے کیا ہر ورکر چلتا ہے on; ریکارڈ کا مستند نظام ہے کیا ہر ورکر چلتا ہے against. ہر AI ورکر reads سے اور writes کو ایک authoritative store کا state." Neon Postgres + pgvector ہے ایک concrete realization کا یہ invariant. thesis ہے واضح: any پائیدار، addressable، governed store افرادی قوت سکتا ہے پڑھیں اور لکھیں satisfies requirement. We استعمال کریں Neon کیونکہ یہ کا free کو شروع کریں، scales کو zero، اور ships ایک official MCP server. ڈھانچہ ہے invariant; پروڈکٹ ہے replaceable.

- ** skills صلاحیت layer.** آپ کا thesis names "صلاحیت packaged بطور portable skills" بطور ایک کا ڈھانچہ کا stable invariants. skills ہیں کھولیں standard (originally Anthropic، اب نظام-wide پر agentskills.io) کہ lets ایک ورکر کا صلاحیتیں live outside اس کا کوڈ، میں فولڈرز ایک agent discovers، loads، اور executes on demand.

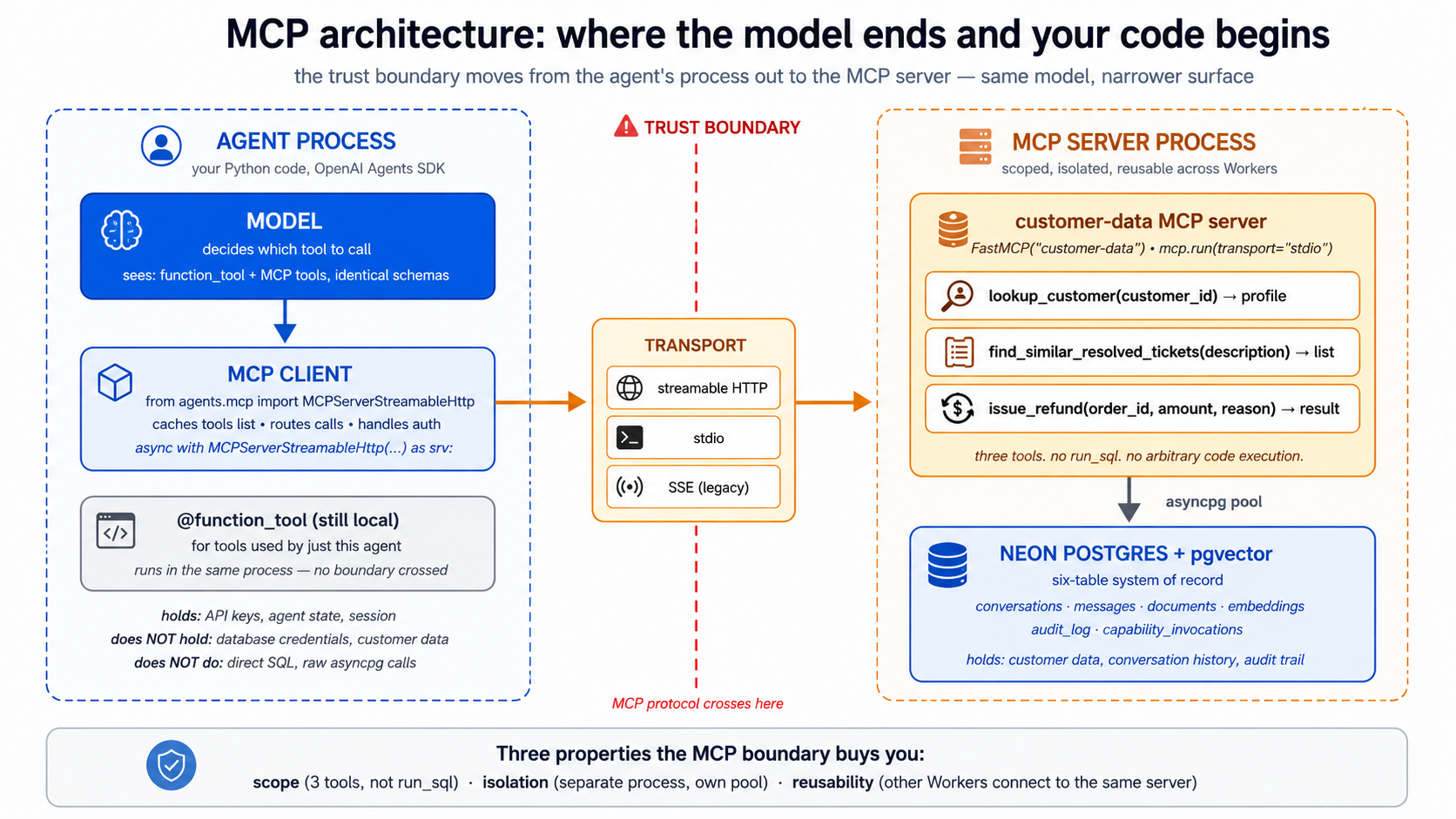

- MCP بطور connector. آپ کا thesis frames MCP بطور "کیسے افرادی قوت reaches" اس کا ریکارڈ کے مستند نظام. Course #3 استعمال ہوا MCP lightly; یہ کورس بناتا ہے MCP load-bearing نمونہ درمیان agent اور Neon.

** thesis sentence، expanded.** دو ڈھانچے سے متعلق فیصلے turn ایک agent میں ایک ورکر:

- کہاں کریں اس کا صلاحیتیں live? In کوڈ، بطور

@function_tooldecorators → fine کے لیے ایک demo. In skill فولڈرز agent discovers پر startup اور loads on demand → fine کے لیے ایک ورکر کہ ships، evolves، gets added کو بغیر redeploying، اور ہے sharable across ورکرز میں وہی کمپنی. - کہاں کرتا ہے اس کا truth live? In RAM اور ایک local SQLite فائل → fine کے لیے ایک chat demo. In ایک پائیدار Postgres ڈیٹا بیس agent reads سے اور writes کو کے تحت audit، کے ساتھ vector search پر کیا یہ has learned → fine کے لیے ایک ورکر کہ has کو جواب "کیا did آپ tell customer six weeks ago?" اور "رکھتے ہیں we seen یہ سوال پہلے?"

connector کہ joins دو ہے ماڈل سیاق و سباق پروٹوکول: ایک کھولیں standard کے لیے کیسے ایک agent reaches external state اور external صلاحیت. کے ذریعے end کا یہ کورس، آپ گا رکھتے ہیں replaced یہ کورس's predecessor کا stub ٹولز اور SQLite سیشن کے ساتھ: three skills agent loads on demand، ایک Neon Postgres + pgvector ڈیٹا بیس holding agent کا authoritative state، اور ایک MCP layer کہ wires انہیں کو agent بغیر coupling agent کو either.

** 15-concept cheat sheet.** ایک ناکامی میں پروڈکشن almost ہمیشہ traces کو ایک کا three root causes: ایک missing یا wrong skill، ایک ریکارڈ کا مستند نظام کہ isn't اصل میں حقیقت کا مستند ماخذ، یا ایک MCP wiring کہ loses ڈیٹا. یہ table ہے diagnostic.

| # | تصور | Layer | کیا سوال یہ جوابات |

|---|---|---|---|

| 1 | کیا ایک Agent skill ہے | skills | کہاں کرتا ہے reusable صلاحیت live? میں ایک فولڈر، کے ساتھ SKILL.md plus optional scripts/references. |

| 2 | Progressive disclosure | skills | کیوں ہیں skills سستا کو رکھیں on hand? Discovery → activation → عمل درآمد loads صرف کیا کا needed جب یہ کا needed. |

| 3 | Writing ایک SKILL.md | skills | کیا کرتا ہے ایک skill فائل اصل میں contain? metadata، trigger description، operational instructions. |

| 4 | skill packaging conventions | skills | کیسے کریں skills travel درمیان ٹولز? وہی فولڈر کام کرتا ہے میں Claude Code، OpenCode، اور any compliant client. |

| 5 | Composing skills | skills | جب کو chain چھوٹا skills via filesystem ہینڈ آف vs. لکھیں ایک big skill. |

| 6 | کیوں managed Postgres | نظام کا record | کیا store earns "ریکارڈ کا مستند نظام"? ایک کے ساتھ persistence، branching، نظم و نگرانی، اور vector بنیادی اکائیاں ایک agent ضرورت ہے. |

| 7 | ورکر کا schema | نظام کا record | کیا tables کرتا ہے ایک agent اصل میں ضرورت? Conversations، messages، دستاویزات، embeddings، audit log، صلاحیت invocations. |

| 8 | pgvector basics | نظام کا record | کیسے کرتا ہے semantic search کام میں Postgres? Embedding column، distance operators، index types. |

| 9 | embedding pipeline | نظام کا record | کیسے کرتا ہے text بن جاتے ہیں ایک queryable vector? Chunking، embedding ماڈل، جب کو re-embed. |

| 10 | audit trail بطور طریقہ کار | نظام کا record | کیا کرتا ہے "reads اور writes" mean کے لیے ایک ورکر? ہر action ایک ورکر لیتا ہے leaves ایک trace کمپنی سکتا ہے replay. |

| 11 | کیا MCP ہے اور isn't | MCP | ایک پروٹوکول کے لیے ٹولز، resources، اور پرامپٹس: نہیں ایک فریم ورک، نہیں ایک service. |

| 12 | Neon MCP server | MCP | agent کا interface کو اس کا ڈیٹا بیس: کیا یہ exposes، کیسے یہ authenticates. |

| 13 | Connecting MCP کو Agents SDK | MCP | SDK's MCP integration: کیسے کو register ایک server، کیا ماڈل sees، کہاں trust boundary lives. |

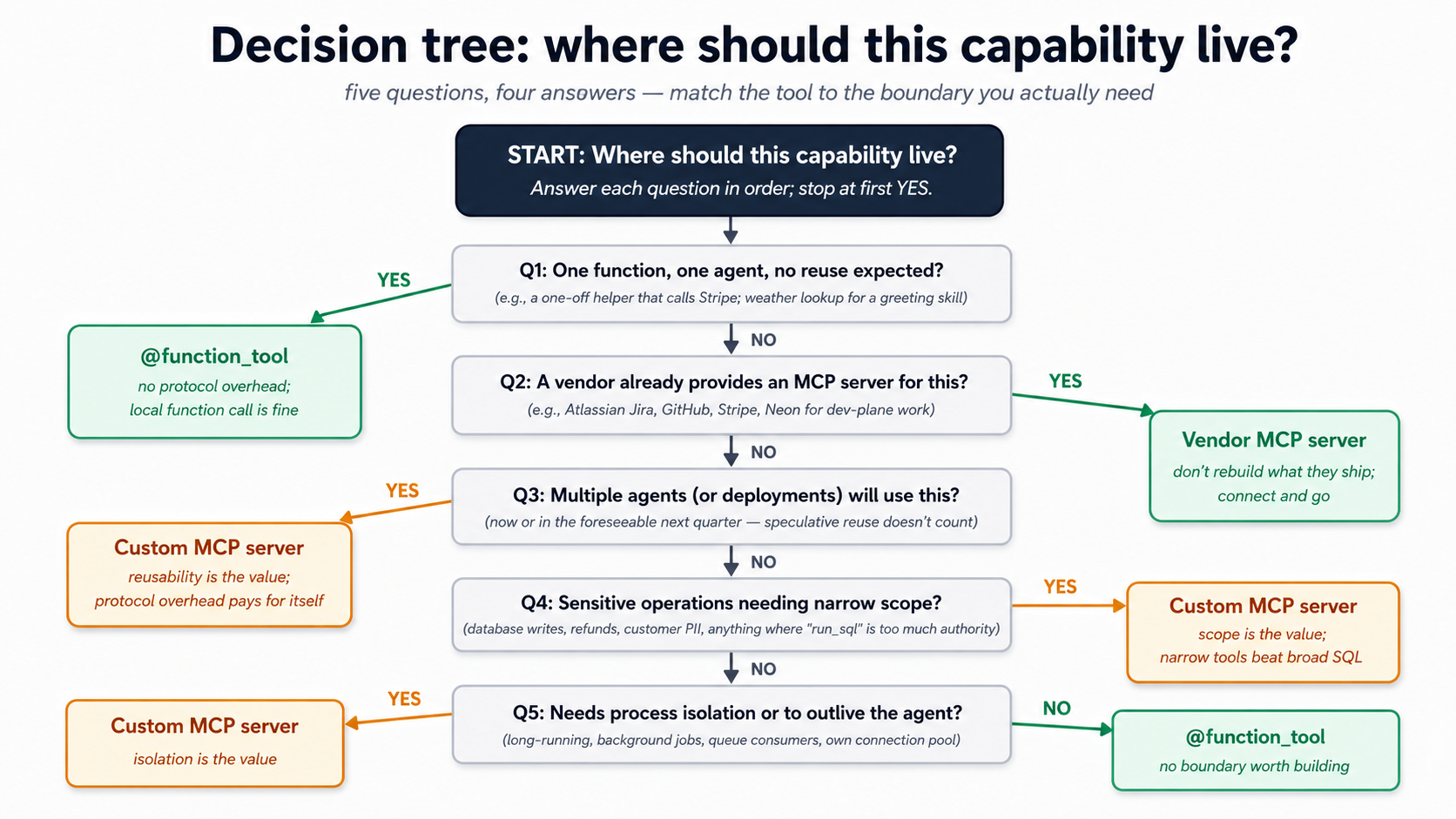

| 14 | custom MCP servers | MCP | جب کو لکھیں آپ کا اپنا server vs. just استعمال کریں @function_tool. فیصلہ tree. |

| 15 | MCP کے تحت load | MCP | Transport choices، connection pooling، جب کو queue. |

Once آپ رکھتے ہیں یہ mapping، rest کا دستاویز ہے mostly mechanics. ایک ناکامی میں پروڈکشن traces کو ایک کا: ایک skill کہ doesn't get discovered (description too vague)، ایک ریکارڈ کا مستند نظام کہ دو ورکرز disagree کے بارے میں (schema race)، یا ایک MCP wiring کہ drops events (transport نہیں chosen کے لیے workload). diagnostic tells آپ کون سا.

Audience اور prerequisites میں 30 seconds. Intermediate کورس. Assumes آپ completed تعمیر AI Agents مختصر عملی کورس (Course #3)، رکھتے ہیں ایجنٹک کوڈنگ مختصر عملی کورس طریقہ کار (منصوبہ طریقہ، قواعد فائلیں)، رکھتے ہیں مکمل پر least ایک PRIMM-AI+ cycle، اور رکھتے ہیں ایک working Postgres ذہنی نمونہ. مکمل audience، prereqs list، اور glossary ہیں میں Appendix A.1 اور A.5 پر end کا صفحہ; flip وہاں اب if آپ're missing ایک کا those پہلے آغاز فوری کامیابی.

موجودہ بطور کا ہو سکتا ہے 14، 2026. Verified کے خلاف openai-agents==0.17.2، mcp==1.27.1، Neon's MCP server documentation، اور pgvector 0.8+ (چلائیں pip index versions openai-agents کے لیے موجودہ pin جب آپ تعمیر کریں). state-and-trust ڈھانچہ یہ کورس سکھاتا ہے کرتا ہے نہیں تبدیلی جب پروڈکٹس کریں; پروڈکٹس ہیں یہ year کا بہترین fit. Cloudflare سینڈ باکس tutorial اور Neon docs ہیں مستند ماخذs کے لیے vendor-specific details. دیکھیں حصہ 5's Swap رہنمائی کے لیے per-product alternatives پر ہر layer (Supabase، Pinecone، Cohere embeddings، LangGraph، اور دwasرے).

OpenAI Agents SDK اور Cloudflare سینڈ باکس stack سے previous کورس ہے foundation کا یہ کورس، نہیں ایک stepping stone we move past. آپ کا agent میں حصہ 4 اب بھی استعمال کرتا ہے Agent، Runner، function_tool، سیشنز، سٹریمنگ events، حفاظتی حدود، اور SandboxAgent کے ساتھ Shell() اور Filesystem() صلاحیتیں. کیا تبدیلیاں: those بنیادی اکائیاں اب sit on top کا ایک skills library اور ایک Neon ریکارڈ کا مستند نظام connected via MCP. previous کورس taught آپ engine. یہ کورس سکھاتا ہے آپ کیا engine چلتا ہے کے خلاف.

Cloudflare سینڈ باکس remains trust boundary کے لیے کوئی بھی چیز agent executes، including skill scripts کہ چلائیں shell commands. Neon ہے ریکارڈ کا مستند نظام. MCP ہے wiring. ڈھانچہ combines ایک کھولیں SDK (OpenAI Agents SDK، MIT-licensed)، ایک کھولیں connector پروٹوکول (MCP)، اور replaceable managed بنیادی ڈھانچا (Cloudflare سینڈ باکس کے لیے عمل درآمد، Neon کے لیے storage)، ہر piece swappable بغیر changing دwasرے. Everything below assumes وہی Python-پہلا stack بطور Course #3 کے ساتھ uv کے لیے package management.

یہ ہے ایک Python-پہلا کورس، like اس کا predecessor. skills format ہے language-agnostic (ایک SKILL.md ہے ایک Markdown فائل، whether آپ کا agent ہے Python یا TypeScript)، اور MCP ہے transport-agnostic، مگر agent we extend میں حصہ 4 ہے وہی Python chat-agent سے Course #3.

dual-ٹول نمونہ سے Course #3 continues یہاں. حصے کہ diverge درمیان Claude Code اور OpenCode رکھتے ہیں ایک switcher; چنیں ایک اور صفحہ syncs across visits.

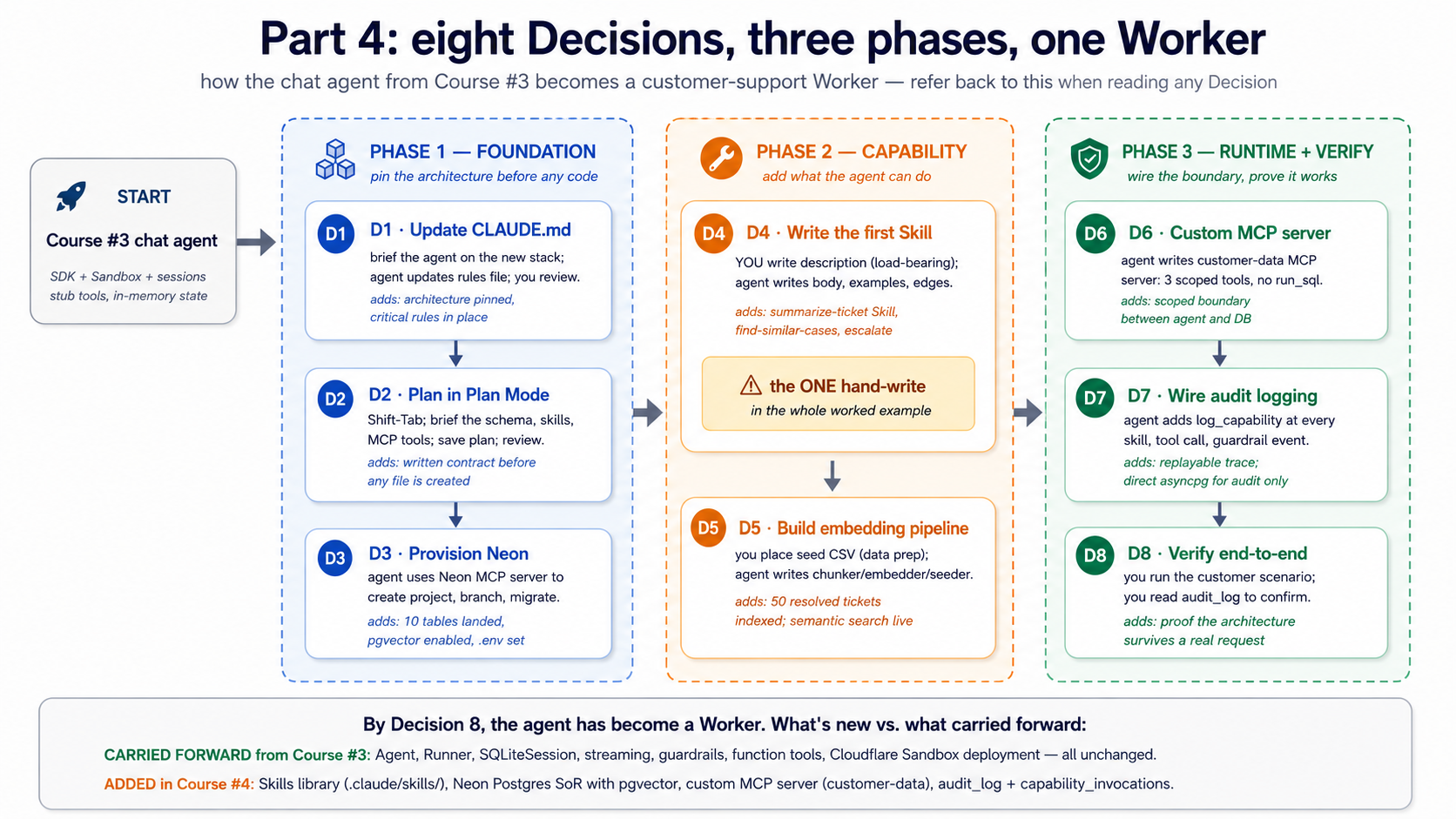

وہاں کا ایک مکمل worked مثال میں حصہ 4: chat agent سے Course #3، evolved میں ایک customer-support ورکر کے ساتھ three skills، ایک Neon ریکارڈ کا مستند نظام، اور ایک MCP wiring layer. Eight تعمیر کریں فیصلے، وہی shape بطور previous کورس's worked مثال. If آپ سیکھیں بہتر سے doing than مطالعہ definitions، سرسری پڑھیں Parts 1–3 اور jump کو حصہ 4.

ڈھانچہ ایک سطر میں. Engine = OpenAI Agents SDK + Cloudflare سینڈ باکس (سے Course #3). صلاحیت = skills (حصہ 1). Truth = Neon Postgres + pgvector (حصہ 2). connector = MCP (حصہ 3). eight تعمیر کریں فیصلے میں حصہ 4 رابطہ all four together. If صرف ایک sentence کا یہ whole دستاویز sticks، کہ کا ایک.

fifteen-minute فوری کامیابی: succeed once، پھر study کیوں یہ worked

پہلے آپ پڑھیں 15 تصورات کہ explain why یہ ڈھانچہ کام کرتا ہے، تعمیر کریں smallest possible نسخہ کا یہ کہ اصل میں کام کرتا ہے. کے ذریعے end کا یہ حصہ آپ'll رکھتے ہیں:

- ایک Postgres table holding agent کا پہلا پائیدار لکھیں

- ایک audit row recording کیا agent did، میں وہی transaction

- ایک MCP boundary agent crossed کو کریں یہ

- ایک skill فولڈر، ready کو activate later جب آپ چلائیں وہی agent سے اندر Claude Code

- ایک working جواب کو سوال "did ریکارڈ کا مستند نظام + MCP boundary اصل میں کریں کوئی بھی چیز کے لیے me?"

یہ ہے نہیں حصہ 4 worked مثال; کہ کا مکمل ورکر، eight فیصلے، hundreds کا lines. یہ ہے ایک screen. If آپ صرف رکھتے ہیں ایک sitting، کریں یہ، پھر come back کے لیے تصورات جب آپ چاہتے ہیں کو جانیں کیوں ہر piece was shaped طریقہ یہ was.

پہلے آپ شروع کریں: یہ continues آپ کا Course #3 پروجیکٹ. فوری کامیابی extends

chat-agent/پروجیکٹ سے Course #3: ایک skill فولڈر، ایک MCP server، اور ~30 lines added کو اس کاcli.py. کے ساتھ کہ پروجیکٹ میں hand یہ ہے دوuvcommands (uv add، پھرuv run). بغیر یہ، کریں Course #3 پہلا، یا scaffold ایک freshuvپروجیکٹ (uv initplus ایک minimal agent-loopcli.py) اور چلائیں three commands بجائے کا دو.

ایک precondition. skill discovery (scanning

.claude/skills/، مطالعہ frontmatter، presenting descriptions کو ماڈل) ہے ایک client صلاحیت میں Claude Code، OpenCode، اور Codex. ایک bareAgent(...)سے OpenAI Agents SDK کرتا ہے not پڑھیں.claude/skills/SKILL.mdon اس کا اپنا. ** فوری کامیابی builds ایک standalone Python chat agent** ( وہیcli.pyshape بطور Course #3) اور routes "Remember یہ: …" via MCP ٹول کا اپنا docstring. skill فولڈر سے Step 1 activates later جب آپ چلائیں وہی agent سے اندر Claude Code; یہ کرتا ہے نہیں fire میں standalone Python path کا فوری کامیابی، اور کہ ہے point: MCP boundary alone ہے enough کو prove ڈھانچہ کام کرتا ہے.

Step 1. میں آپ کا Course #3 chat-agent/ پروجیکٹ، بنائیں ایک skill فولڈر کے ساتھ ایک فائل:

mkdir -p .claude/skills/log-a-note

cat > .claude/skills/log-a-note/SKILL.md << 'EOF'

---

name: log-a-note

description: Saves a short text note to the durable notes table in Postgres, along with a timestamp. Use when the user says "remember this", "save a note", "log that", or otherwise asks for something to be persisted between sessions. Returns the row_id of the saved note.

---

# Log a note

When this skill activates:

1. Extract the note text from the user's message — everything after "remember:" or "save this:" or similar trigger phrases, or the whole message if no trigger phrase is used.

2. Call the `save_note` tool with the extracted text.

3. Reply with one short sentence confirming the save and citing the row_id.

EOF

Step 2. بنائیں ایک Postgres table اور ایک tiny audit table on ایک fresh ڈیٹا بیس یا Neon branch، نہیں ایک کہ پہلے ہی has tables. (استعمال کریں Neon's ویب console، یا CREATE DATABASE on any Postgres آپ قابو; آپ don't ضرورت pgvector yet.) names notes اور audit_log ہیں generic enough کو collide کے ساتھ ایک existing schema، اور CREATE TABLE below assumes ایک empty target.

CREATE TABLE notes (

id UUID PRIMARY KEY DEFAULT gen_random_uuid(),

note_text TEXT NOT NULL,

created_at TIMESTAMPTZ NOT NULL DEFAULT NOW()

);

CREATE TABLE audit_log (

id BIGSERIAL PRIMARY KEY,

action TEXT NOT NULL,

payload JSONB NOT NULL,

created_at TIMESTAMPTZ NOT NULL DEFAULT NOW()

);

Step 3. لکھیں ایک 30-سطر MCP server exposing ایک ٹول. مکمل نمونہ دکھاتا ہے up again میں تصور 14 اور فیصلہ 6; یہ ہے smallest possible نسخہ:

# notes_mcp.py

import json

import os

import asyncpg

from mcp.server.fastmcp import FastMCP

mcp = FastMCP("notes")

_pool = None

async def pool():

global _pool

if _pool is None:

_pool = await asyncpg.create_pool(os.environ["DATABASE_URL"])

return _pool

@mcp.tool()

async def save_note(text: str) -> dict[str, str]:

"""Save a note to the durable notes table. Returns the row_id."""

p = await pool()

async with p.acquire() as c:

async with c.transaction():

row_id = await c.fetchval(

"INSERT INTO notes (note_text) VALUES ($1) RETURNING id::text", text)

await c.execute(

"INSERT INTO audit_log (action, payload) VALUES ($1, $2::jsonb)",

"note_saved",

json.dumps({"row_id": row_id, "len": len(text)}),

)

return {"row_id": row_id, "status": "saved"}

if __name__ == "__main__":

mcp.run(transport="stdio")

audit payload goes کے ذریعے json.dumps()، نہیں ایک f-string. فوری کامیابی values یہاں ہیں injection-free کے ذریعے accident (UUID اور int)، مگر worked مثال گا accept صارف-influenced strings; safe نمونہ ہے وہی میں دونوں places. row_id اہم ہے load-bearing: verification query میں Step 5 joins on payload->>'row_id'، اس لیے کہ اہم has کو be میں payload آپ لکھیں.

Step 4. تعمیر agent. پہلا، install SDK، DB driver، اور MCP package (skip کیا آپ پہلے ہی رکھتے ہیں سے Course #3):

uv add openai-agents asyncpg mcp

پھر میں آپ کا Course #3 chat-agent/cli.py، imports اور main() wiring دیکھیں like یہ ( rest کا cli.py ہے unchanged سے Course #3):

# cli.py — Quick Win shape

import asyncio

import os

from agents import Agent, OpenAIChatCompletionsModel, Runner, set_tracing_disabled

from agents.mcp import MCPServerStdio

from openai import AsyncOpenAI

# Only if your backend is not OpenAI (DeepSeek, OpenRouter, local proxy):

set_tracing_disabled(True)

async def main():

# The OpenAI Agents SDK accepts any OpenAI-API-compatible backend.

# Set OPENAI_BASE_URL only when pointing at a non-OpenAI host.

client = AsyncOpenAI(

api_key=os.environ["OPENAI_API_KEY"],

base_url=os.environ.get("OPENAI_BASE_URL"),

)

model = OpenAIChatCompletionsModel(

model=os.environ["MODEL_NAME"],

openai_client=client,

)

async with MCPServerStdio(

name="notes",

params={

"command": "python",

"args": ["notes_mcp.py"],

"env": {**os.environ}, # inherit PATH + DATABASE_URL into the subprocess

},

) as notes:

agent = Agent(

name="ChatAgent",

model=model,

mcp_servers=[notes],

instructions="You are a helpful assistant. Use the tools available to you.",

)

result = await Runner.run(

agent,

"Remember this: the production deploy needs a new env var before Friday.",

)

print(result.final_output)

if __name__ == "__main__":

asyncio.run(main())

دو details worth naming. env={**os.environ} ہے عملی fix کے لیے زیادہ تر عام فوری کامیابی ناکامی: pass صرف DATABASE_URL اور spawned subprocess loses PATH، اس لیے python notes_mcp.py ہے نہیں even findable on some shells. Inherit parent env اور subprocess starts cleanly. set_tracing_disabled(True) silences SDK's trace-upload attempt کے خلاف platform.openai.com جب آپ کا بیک اینڈ ہے something else. Drop call if آپ're استعمال کرتے ہوئے OpenAI کے لیے حقیقی.

Step 5. چلائیں یہ.

export DATABASE_URL='postgresql://…/your_db?sslmode=require'

export OPENAI_API_KEY='sk-…' # OpenAI, DeepSeek, OpenRouter, whatever you have

# Pick any model your provider serves. Common choices:

# 'gpt-4o' or 'gpt-5.5' (OpenAI), 'deepseek-chat' (DeepSeek),

# 'meta-llama-3.1-…' (OpenRouter), etc.

export MODEL_NAME='gpt-4o'

# UNCOMMENT THIS UNLESS your OPENAI_API_KEY is from OpenAI itself.

# DeepSeek, OpenRouter, and other OpenAI-API-compatible providers need

# the base URL set, otherwise the SDK will hit api.openai.com with your

# non-OpenAI key and you'll see a 401.

# export OPENAI_BASE_URL='https://api.deepseek.com/v1'

# Smoke-test the key before the full run. This should print the start of a

# JSON model list; a 401 here means the key or OPENAI_BASE_URL is wrong, and

# you learn that in one second instead of four files deep.

curl -sS "${OPENAI_BASE_URL:-https://api.openai.com/v1}/models" \

-H "Authorization: Bearer $OPENAI_API_KEY" | head -c 200; echo

uv run python cli.py

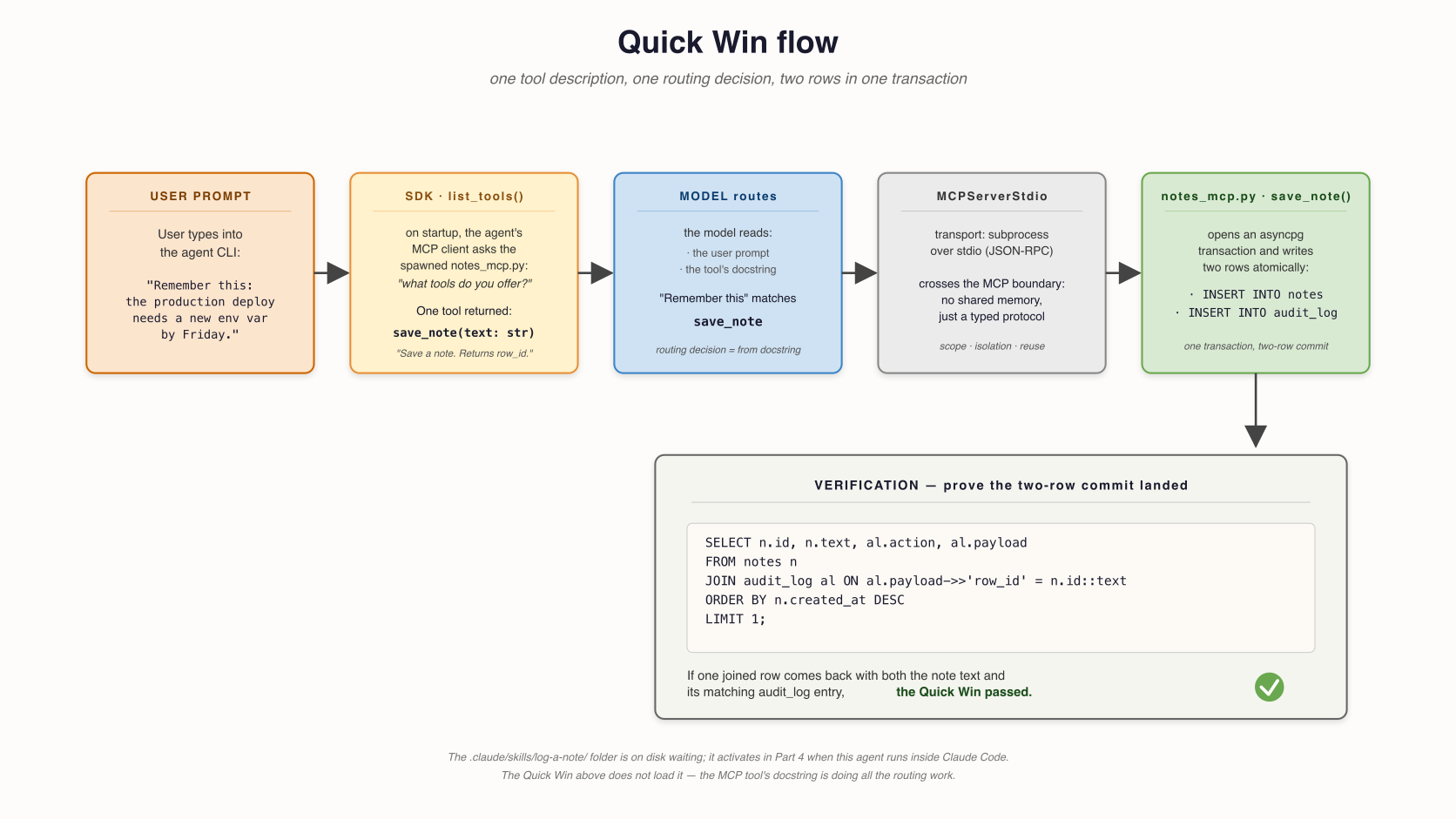

MCP ٹول کا docstring ہے صرف routing signal: ماڈل matches "Remember یہ: …" کو save_note، calls یہ، اور server writes دونوں rows میں ایک transaction. ایک MCP boundary، ایک trigger word، ایک transaction ( figure below traces مکمل path).

The MCP ٹول کا docstring ہے doing all routing کام. ایک transaction writes دونوں rows. ایک JOIN verifies commit. .claude/skills/log-a-note/ فولڈر sits on disk waiting; یہ joins picture میں حصہ 4 جب وہی agent چلتا ہے اندر Claude Code.

** verification، میں ایک SQL query:**

SELECT n.id, n.note_text, n.created_at, al.action, al.payload

FROM notes n

JOIN audit_log al ON al.payload->>'row_id' = n.id::text

ORDER BY n.created_at DESC LIMIT 1;

If آپ دیکھیں آپ کا note text میں ایک row اور "action": "note_saved" کے ساتھ ایک matching row_id میں joined audit row، ** ڈھانچہ ہے working.** ایک ریکارڈ کا مستند نظام کہ holds truth. ایک MCP boundary agent crossed کو لکھیں یہ. ایک جانچ کا ریکارڈ آپ سکتا ہے replay. ( skill فولڈر ہے on disk waiting; یہ joins picture میں حصہ 4 جب وہی agent چلتا ہے سے اندر Claude Code.)

یہ ہے ایک skill، ایک ٹول، دو tables، اور ~50 lines کا نیا کوڈ. حصہ 4 worked مثال scales وہی نمونہ کو three skills، ten tables، three MCP ٹولز، اور ایک embedding pipeline، مگر shape ہے identical. If یہ فوری کامیابی worked، rest کا کورس ہے explaining کیوں ہر piece ہے shaped طریقہ یہ ہے اور کیا تبدیلیاں جب آپ wasیع کرنا یہ up.

If something didn't کام، scan "جب something feels wrong" table near end کا دستاویز; یہ maps ہر عام ناکامی کو concept کہ explains یہ. پھر come back یہاں.

حصہ 1: skills، صلاحیت بطور portable فولڈرز

previous کورس's agent had اس کا صلاحیتیں baked میں Python. ہر ٹول was ایک @function_tool-decorated function میں tools.py; ہر behavior was ایک instruction string میں agents.py. کہ worked کے لیے ایک demo. یہ کرتا ہے نہیں کام کے لیے ایک افرادی قوت. skills extract صلاحیت باہر کا کوڈ اور میں فولڈرز agent discovers، loads، اور executes on demand: version-controlled، sharable across agents، addable بغیر redeploying.

تصور 1: کیا ایک Agent skill ہے

ایک Agent skill ہے ایک فولڈر containing ایک SKILL.md فائل plus optional scripts، references، اور assets. فولڈر is skill; SKILL.md ہے اس کا entry point. format was originally released کے ذریعے Anthropic، ہے اب ایک کھولیں standard published پر agentskills.io کے ساتھ ایک growing نظام کا clients (Claude Code، OpenCode، Codex، Cursor، Gemini CLI، Junie، اور زیادہ).

minimum viable skill:

hello-skill/

└── SKILL.md

کے ساتھ contents:

---

name: hello-skill

description: A skill that responds with a friendly greeting tailored to the user's name and the time of day. Use when the user asks to be greeted, says hello, or starts a conversation.

---

# Hello skill

When the user greets you or asks to be greeted:

1. Determine the current local time of day.

2. Compose a friendly, time-appropriate greeting that uses the user's name if available.

3. Keep the greeting under 25 words.

Examples:

- Morning + name known: "Good morning, Sara — hope your week is starting well."

- Evening + no name: "Good evening — happy to be of help."

کہ کا ایک مکمل، valid skill. agent گا دیکھیں یہ پر startup ( name اور description)، load body جب ایک کام matches description، اور act on instructions. نہیں کوڈ. نہیں ڈیپلائمنٹ. نہیں SDK call. ایک فولڈر کے ساتھ ایک markdown فائل.

یہ ہے load-bearing observation. skills ہیں نہیں Python objects آپ import. They ہیں نہیں API endpoints آپ call. They ہیں نہیں فریم ورک بنیادی اکائیاں آپ instantiate. They ہیں فائلیں on disk agent discovers اور executes. کہ property ( فائل-on-disk property) ہے کیا بناتا ہے انہیں portable across ٹولز، shareable across ٹیمیں، اور version-controllable like any دwasرا text آرٹفیکٹ.

PRIMM، Predict. دیا گیا

hello-skillفولڈر above، کیا کرتا ہے agent load میں سیاق و سباق پر startup، پہلے any صارف message arrives? Three options: (ایک) entireSKILL.mdفائل، including instructions; (b) just frontmatternameاورdescription، nothing else; (c) nothing، since skills load صرف جب invoked. Confidence 1–5.

جواب ہے (b). پر startup، agent reads صرف metadata کے لیے ہر skill میں اس کا skill library. مکمل body ( instructions، مثالیں، references) loads on demand. یہ ہے progressive disclosure، اور یہ کا اگلا concept.

Try کے ساتھ AI

I want to write my first Agent Skill. Give me three skill ideas

suitable for a customer-support agent. For each, write the frontmatter

(name + description) only. The description must be specific enough

that the agent knows EXACTLY when to invoke it — vague descriptions

like "Helps with tickets" don't count. After I review your three,

ask me which I'd refine first.

تصور 2: Progressive disclosure، three-stage skill loading ماڈل

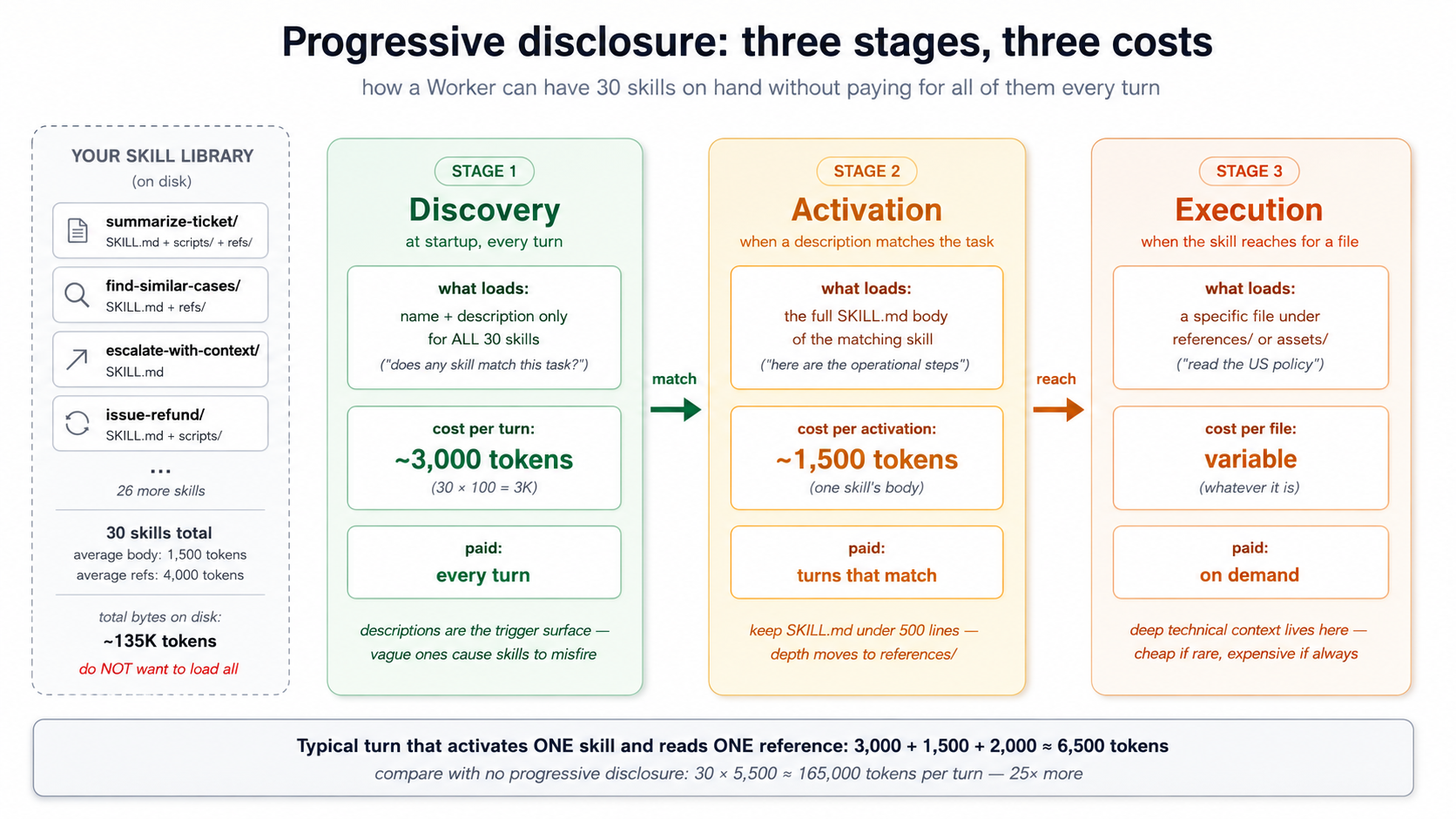

ایک chat agent کے ساتھ ایک skill has trivial سیاق و سباق لاگت. ایک ورکر کے ساتھ fifty skills doesn't، unless loading ماڈل ہے clever. Progressive disclosure ہے clever part. skills load میں three stages، ہر زیادہ مہنگا than last، صرف loading اگلا stage جب previous stage indicates skill ہے relevant.

Stage 1، Discovery. پر startup، agent loads name اور description کا ہر دستیاب skill. spec recommends keeping یہ footprint tiny: roughly 100 tokens per skill. ایک ورکر کے ساتھ fifty skills pays roughly 5،000 tokens کے لیے discovery، ہر turn، ہر conversation. کہ کا لاگت کا knowing کیا کا میں library.

Stage 2، Activation. جب ماڈل decides ایک کام matches ایک skill کا description، یہ loads مکمل SKILL.md body میں سیاق و سباق. spec recommends keeping یہ کے تحت 5،000 tokens per skill. زیادہ تر well-written skills sit پر 500–2،000 tokens. activation لاگت ہے paid صرف on turns کہ اصل میں استعمال کریں skill.

Stage 3، Execution. If skill کا instructions reference دwasرا فائلیں (ایک script کے تحت scripts/، ایک reference کے تحت references/، ایک template کے تحت assets/)، those load صرف جب agent explicitly reaches کے لیے انہیں. Some skills never load any references; deep تکنیکی skills might load three یا four.

ایک short walkthrough کا کیا یہ looks like میں practice. Imagine آپ کا customer-support ورکر has 30 skills میں .claude/skills/، ہر کے ساتھ ایک SKILL.md. agent starts; runtime reads ہر SKILL.md اور extracts YAML frontmatter صرف (name اور description) کے لیے all 30 فائلیں. Roughly 3،000 tokens land میں ماڈل کا سیاق و سباق بطور ایک table کا "دستیاب skills." body کا ہر SKILL.md ہے not loaded; references کے تحت references/ ہیں not loaded; scripts کے تحت scripts/ ہیں not even پڑھیں. ماڈل اب knows کیا ٹولز یہ has، مگر نہیں کیسے کو استعمال کریں any کا انہیں.

صارف sends ایک message: "لائیں me up کو speed on ticket TKT-1042." ماڈل scans اس کا 30-description list، matches summarize-ticket description (کون سا mentions "ticket ID،" "لائیں me up کو speed")، اور decides یہ skill applies. Now runtime loads مکمل summarize-ticket/SKILL.md body، کے بارے میں 1،500 tokens، میں سیاق و سباق. ماڈل reads operational instructions: "extract ticket ID، call lookup_customer، call find_similar_resolved_tickets، compose ایک five-section summary." یہ follows instructions.

Step 3 کا those instructions references references/style.md، formatting رہنمائی کے لیے summaries. ماڈل reaches کے لیے کہ فائل; runtime loads یہ on demand. دwasرا 29 skills' bodies، دwasرا reference فائلیں، scripts کے تحت scripts/: none کا یہ ever entered ماڈل کا سیاق و سباق. صرف metadata کے لیے all 30، plus body اور ایک reference کے لیے one skill کہ fired، was paid کے لیے. Predict below puts numbers on کہ gap.

PRIMM، Predict. ایک ورکر has 30 skills میں اس کا library. average SKILL.md frontmatter ہے 80 tokens; average body ہے 1،500 tokens; ہر skill has on average دو reference فائلیں totalling 4،000 tokens کا references. On ایک typical turn کہ activates ایک skill اور reads ایک reference، کیا ہے rough سیاق و سباق لاگت کا skill نظام? Three options: (ایک) ~2،400 tokens (startup metadata + ایک activation + ایک reference); (b) ~6،900 tokens; (c) ~135،000 tokens (everything loaded all وقت). Confidence 1–5.

جواب ہے (b)، roughly 6،900 tokens: 30 × 80 tokens کے لیے discovery (2،400)، plus 1،500 tokens کے لیے ایک activated skill، plus ~2،000 tokens کے لیے ایک referenced فائل. لاگت scales linearly کے ساتھ library size کے لیے discovery، اور constant per-turn کے لیے activation اور عمل درآمد. یہ ہے کیا بناتا ہے ایک skill library affordable. بغیر progressive disclosure، 30 skills × 1،500 tokens کا body × 4،000 tokens کا references = 165،000 tokens per turn just کو جانیں کیا agent سکتا ہے کریں. Nobody چلتا ہے کہ.

دو consequences کے لیے skill ڈیزائن:

-

Descriptions ہیں load-bearing field. They're کیا fires میں Stage 1 اور determines whether Stage 2 ہوتا ہے پر all. ایک vague description ("مدد کرتا ہے کے ساتھ PDFs") fires too often اور burns activation tokens کے لیے nothing; ایک sharp description ("extracts text اور tables سے PDFs، fills PDF forms، merges PDFs; استعمال کریں جب working کے ساتھ PDF فائلیں") fires جب یہ چاہیے اور stays quiet جب یہ shouldn't. زیادہ تر skill ناکامیاں ہیں description ناکامیاں.

-

Long SKILL.md bodies ہیں مہنگا. رکھیں

SKILL.mdکے تحت ~500 lines، ideally 100–300. Move depth میں reference فائلیں. 500-سطر limit isn't arbitrary; یہ کا threshold کہاں activation لاگت starts crowding باہر اصل استدلال سیاق و سباق.

Try کے ساتھ AI

I have a SKILL.md that's grown to 1,200 lines because I kept adding

edge cases. Walk me through how to split it. The skill is a

"customer-refund-issuance" skill: it has the core refund process,

five edge cases (international, partial, post-30-days, with-restocking-fee,

fraud-flagged), three reference policies (US, EU, UK), and a Python script

that calls the payment gateway. Help me decide what stays in SKILL.md,

what moves to references/, what moves to assets/, and what stays as scripts/.

تصور 3: Writing ایک SKILL.md، contract ایک skill بناتا ہے کے ساتھ ماڈل

SKILL.md فائل has دو parts: YAML frontmatter ( contract) اور Markdown body ( operational instructions). frontmatter ہے agent-facing API; body ہے doing.

** frontmatter، کے ذریعے field.**

| Field | Required | Constraint | Purpose |

|---|---|---|---|

name | Yes | 1–64 chars، lowercase alphanumeric + hyphens، نہیں leading/trailing/consecutive hyphens، لازمی match فولڈر name | skill کا identifier. |

description | Yes | 1–1024 chars، non-empty | trigger surface. کیا agent reads پر discovery کو decide whether کو invoke یہ skill. |

license | نہیں | License name یا path کو bundled license فائل | کیا اصطلاحات skill ships کے تحت. |

compatibility | نہیں | ≤500 chars | Environment requirements (intended پروڈکٹ، نظام packages، network access). زیادہ تر skills don't ضرورت یہ. |

metadata | نہیں | Arbitrary key-قدر mapping | Client-specific extensions (author، نسخہ، etc.). |

allowed-tools | نہیں | Space-separated ٹول list | Pre-approved ٹولز skill ہو سکتا ہے استعمال کریں. Experimental; سپورٹ varies. |

minimum viable frontmatter ہے دو fields:

---

name: my-skill

description: One sentence explaining what this skill does and when to use it.

---

ایک زیادہ پروڈکشن-shaped frontmatter:

---

name: extract-meeting-notes

description: Extracts structured action items, decisions, and follow-ups from raw meeting transcripts. Use when the user provides a transcript, meeting recording text, or asks to summarize a meeting. Produces a markdown summary with explicit sections for Decisions, Action Items (with owner and deadline), and Follow-ups.

license: MIT

compatibility: Requires Python 3.12+ and access to the OpenAI API.

metadata:

author: panaversity

version: "1.2"

---

** description ہے load-bearing field.** Reread spec کا اچھا vs. poor مثالیں اور internalize difference:

اچھا: "Extracts text اور tables سے PDF فائلیں، fills PDF forms، اور merges multiple PDFs. استعمال کریں جب working کے ساتھ PDF دستاویزات یا جب صارف mentions PDFs، forms، یا دستاویز extraction."

Poor: "مدد کرتا ہے کے ساتھ PDFs."

اچھا description says کیا ("extracts text اور tables، fills forms، merges")، جب ("جب working کے ساتھ PDF دستاویزات یا جب صارف mentions PDFs، forms، یا دستاویز extraction")، اور surfaces specific keywords ماڈل سکتا ہے match کے خلاف ("PDFs،" "forms،" "extraction"). poor ایک says none کا those. Description quality ہے single biggest determinant کا whether آپ کا skill fires جب یہ چاہیے اور stays quiet جب یہ shouldn't.

** body، کے ذریعے convention.** نہیں format requirements; spec says "لکھیں whatever مدد کرتا ہے agents perform کام effectively." مگر three حصے دکھائیں up میں nearly ہر well-written skill:

-

Step-by-step instructions. کیا agent کرتا ہے، میں numbered steps، میں operational language. نہیں narrative ("یہ skill ہے ڈیزائن کیا گیا کو مدد کے ساتھ refunds") مگر imperative ("دیکھیں up order. چیک policy. issue refund."). Imperative skills چلائیں بہتر than narrative ones.

-

مثالیں کا inputs اور نتائج. ایک یا دو short مثالیں کہ دکھائیں expected shape کا input اور expected shape کا نتیجہ. مثالیں ہیں worth roughly five times زیادہ than descriptions کے لیے steering ماڈل behavior. Don't skip انہیں.

-

عام edge cases. دو یا three cases کہ aren't obvious سے happy path، typically cases کہ رکھتے ہیں اصل میں broken میں پروڈکشن. Edge cases earn ان کا place کے ذریعے being سے حقیقی ناکامیاں، نہیں imagined ones.

PRIMM، Predict. دو skills رکھتے ہیں وہی

namefield (summarize-document) مگر live میں مختلف فولڈرز: ایک میں~/.claude/skills/(صارف-level) اور ایک میں.claude/skills/(project-level). موجودہ کام matches دونوں descriptions. کیا ہوتا ہے? Three options: (ایک) agent picks ایک پر random; (b) project-level skill wins کیونکہ کا فولڈر precedence; (c) agent loads دونوں اور lets ماڈل چنیں. Confidence 1–5.

جواب depends on client، مگر prevailing convention across Claude Code اور OpenCode ہے (b)، project-level wins پر صارف-level. وہی precedence نمونہ بطور CLAUDE.md resolution، agentic-coding مختصر عملی کورس's قواعد-فائل behavior، اور زیادہ تر ٹول configuration. اصول: زیادہ specific سیاق و سباق overrides زیادہ عمومی سیاق و سباق. دو skills کے ساتھ وہی name سے وہی فولڈر ہے ایک مختلف problem; کہ ایک ہے usually ایک error، since فولڈر names لازمی match name values.

Try کے ساتھ AI

You have two skills in the same project:

- name: lookup-customer

description: Looks up a customer record.

- name: get-customer-profile

description: Retrieves customer profile information.

A user asks: "What's John Smith's email?"

Walk through three steps with the AI:

1. For each skill, predict whether it WILL fire on this prompt.

Confidence 1-5.

2. If both fire, the model has to pick one — predict which it picks

and why.

3. Rewrite BOTH descriptions so exactly one fires on this prompt,

and the other fires only on a clearly different prompt. State the

prompt that SHOULD fire the other skill.

تصور 4: skill packaging، کہاں skills live اور کیسے they travel

skills ہیں filesystem آرٹفیکٹس. کہ کا کیا بناتا ہے انہیں portable; یہ کا بھی کیا بناتا ہے ان کا packaging conventions matter. Get فولڈر ڈھانچہ درست اور آپ کا skill کام کرتا ہے میں ہر compliant client; get یہ wrong اور یہ کام کرتا ہے میں none.

کہاں ہر ٹول looks کے لیے skills.

| ٹول | Project-level | صارف-level (عالمی) |

|---|---|---|

| Claude Code | .claude/skills/<skill-name>/SKILL.md | ~/.claude/skills/<skill-name>/SKILL.md |

| OpenCode | .opencode/skills/<skill-name>/SKILL.md | ~/.config/opencode/skills/<skill-name>/SKILL.md |

| OpenCode (fallback) | .claude/skills/<skill-name>/SKILL.md | ~/.claude/skills/<skill-name>/SKILL.md |

** OpenCode fallback ہے load-bearing piece کے لیے portability.** OpenCode reads سے اس کا اپنا .opencode/skills/ پہلا، مگر falls back کو .claude/skills/ if ایک skill isn't found وہاں. عملی consequence: لکھیں آپ کا skill once میں .claude/skills/، اور یہ کام کرتا ہے میں دونوں ٹولز بغیر modification. یہ ہے زیادہ تر concrete payoff کا کھولیں Agent skills format. وہی SKILL.md آپ ship کو ایک Claude Code صارف کام کرتا ہے کے لیے ایک OpenCode صارف، byte-for-byte.

** مکمل فولڈر ڈھانچہ، کے ذریعے directory.**

my-skill/

├── SKILL.md # Required: frontmatter + body. The entry point.

├── scripts/ # Optional: executable code the skill can run.

│ ├── extract.py

│ └── normalize.sh

├── references/ # Optional: deep documentation, loaded on demand.

│ ├── REFERENCE.md

│ └── policies/

│ └── us-refund-policy.md

└── assets/ # Optional: templates, schemas, lookup tables.

├── report-template.md

└── status-codes.json

ہر directory has ایک specific job:

-

scripts/holds executable کوڈ agent سکتا ہے چلائیں. Python، Bash، JavaScript: language سپورٹ depends on client اور سینڈ باکس. agent invokes scripts کے ذریعے relative path (e.g.،scripts/extract.py). Scripts چاہیے be خود مکمل، دستاویز ان کا dependencies میں ایک comment header، اور handle edge cases gracefully کیونکہ agent گا نہیں. -

references/holds deep documentation agent loads on demand. convention: رکھیں ہر reference فائل focused on ایک topic (finance.md،legal.md،error-codes.md) اس لیے agent loads صرف کیا موجودہ کام ضرورت ہے. ایک 5،000-token reference فائل agent reaches once per سیشن ہے سستا; ایک 50،000-token reference فائل ہے نہیں. رکھیں references ایک level deep سے SKILL.md. بچیںreferences/category/subcategory/file.md-style nesting; spec ہے explicit on یہ. -

assets/holds static resources: دستاویز templates، configuration templates، lookup tables، schemas، images. یہ ہیں consumed کے ذریعے agent (یا کے ذریعے scripts agent چلتا ہے) مگر نہیں read بطور instructions.

** فائل reference syntax اندر SKILL.md.** استعمال کریں relative paths سے skill root:

For policy details, see [the US refund policy](references/policies/us-refund-policy.md).

To extract the structured data, run `scripts/extract.py`.

The output should follow the template in `assets/report-template.md`.

agent reads SKILL.md body، sees path، اور loads referenced فائل on demand. نہیں special syntax، نہیں لنک resolution gymnastics، just relative paths.

فوری چیک. آپ رکھتے ہیں ایک skill پر

.claude/skills/refund-issuance/SKILL.mdکہ referencesreferences/policies/us.md. skill ہے being invoked جبکہ agent کا working directory ہے/home/user/projects/customer-support. کہاں کرتا ہے agent دیکھیں کے لیے policy فائل? جواب:/home/user/projects/customer-support/.claude/skills/refund-issuance/references/policies/us.md; paths ہیں relative کو skill کا directory، نہیں agent کا working directory. Get یہ wrong اور آپ کا skill breaks میں subtle طریقے کے تحت ڈیپلائمنٹ.

Try کے ساتھ AI

I'm porting a skill from Claude Code to OpenCode and want to verify

my folder layout is correct. The skill is at .claude/skills/extract-meeting-notes/

and contains SKILL.md, scripts/parse.py, and references/glossary.md.

For each of these claims, tell me TRUE or FALSE and explain why:

1. Without any changes, this skill will be discovered by OpenCode.

2. If I move the folder to .opencode/skills/extract-meeting-notes/,

Claude Code will stop discovering it.

3. The script reference inside SKILL.md should use the absolute path

~/.claude/skills/extract-meeting-notes/scripts/parse.py.

4. If two skills have the same name and one is in .claude/skills/

and the other in ~/.claude/skills/, the user-level one wins.

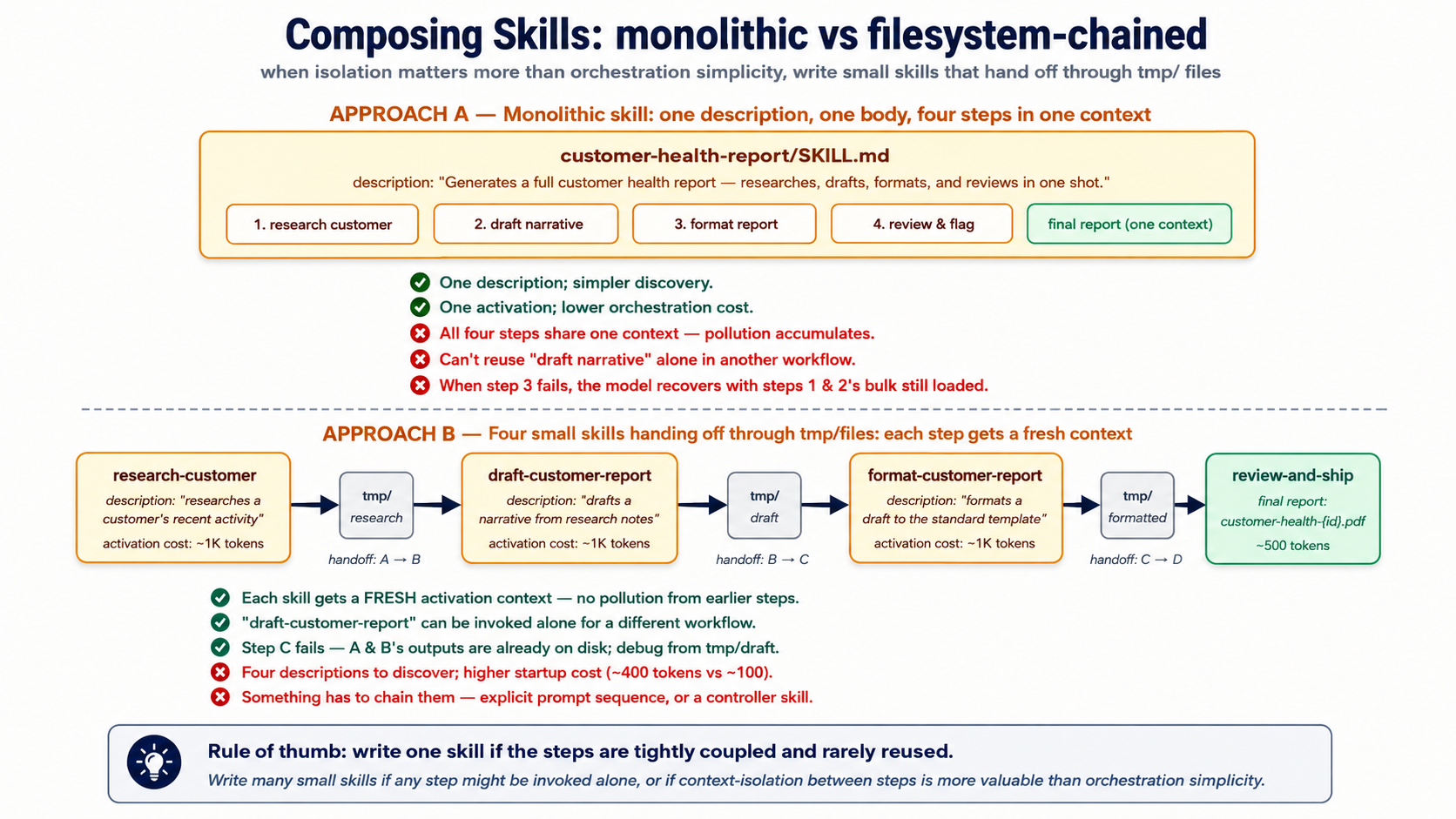

تصور 5: Composing skills، جب کو chain چھوٹا skills vs. لکھیں ایک big ایک

skills compose. ایک "weekly customer-health report" صلاحیت could be ایک giant skill کہ کرتا ہے research، drafting، formatting، اور review میں ایک shot. یا یہ could be four skills (research-customer-health، draft-customer-health-report، format-customer-health-report، review-customer-health-report) کہ hand off کو ہر دwasرا کے ذریعے filesystem.

دونوں کام. They رکھتے ہیں بہت مختلف properties.

ایک big skill. Easier کو discover (ایک description، ایک match). Lower discovery لاگت (ایک entry میں discovery stage). Tighter coupling: جب activation triggers، all steps چلائیں، میں order، میں ایک سیاق و سباق. مشکل کو test میں isolation. مشکل کو reuse ایک piece elsewhere. جب something fails halfway کے ذریعے، ماڈل has کو recover کے ساتھ all کا now-irrelevant earlier کام اب بھی میں سیاق و سباق.

بہت سے چھوٹا skills. Higher discovery لاگت (four entries بجائے کا ایک). Higher activation orchestration لاگت (something has کو chain انہیں). Looser coupling: ہر step سکتا ہے be tested، replaced، یا reused independently. جب ایک fails، ناکامی ہے localized; prior steps' آرٹفیکٹس ہیں پہلے ہی on disk. ہر step gets ایک fresh activation، meaning نہیں accumulated سیاق و سباق pollution.

فیصلہ قاعدہ کہ کام کرتا ہے میں practice:

لکھیں ایک skill if steps ہیں tightly coupled اور rarely reused میں isolation. لکھیں بہت سے skills if any step might be invoked on اس کا اپنا سے ایک مختلف ورک فلو، یا if سیاق و سباق-isolation درمیان steps ہے زیادہ valuable than orchestration simplicity.

کے لیے ایک ورکر کہ کرتا ہے کسٹمر سپورٹ، summarize-ticket ہے probably اس کا اپنا skill (استعمال ہوا کے ذریعے humans، استعمال ہوا کے ذریعے escalation flow، استعمال ہوا کے ذریعے weekly digest، استعمال ہوا کے ذریعے audit replay). escalate-to-tier-2 ہے probably اس کا اپنا skill ( escalation معیار اور tone requirements ہیں reused). decomposition ہے قدر-of-isolation versus لاگت-of-orchestration; isolation usually wins past دو یا three composed steps.

** filesystem ہینڈ آف نمونہ.** جب skills compose، cleanest ہینڈ آف ہے filesystem، نہیں conversation. skill ایک writes اس کا نتیجہ کو tmp/research-customer-{id}.md. skill B ہے invoked، reads سے tmp/research-customer-{id}.md، writes کو tmp/draft-customer-{id}.md. skill C reads draft، writes report. conversation صرف sees final report; intermediate آرٹفیکٹس live on disk کہاں agent سکتا ہے re-read انہیں، human سکتا ہے inspect انہیں، اور جانچ کا ریکارڈ سکتا ہے find انہیں later. یہ ہے وہی نمونہ Course #3 استعمال ہوا کے لیے subagent نتیجہ isolation: وہی insight، applied پر skill granularity.

customer-health-pipeline/

├── tmp/ # ephemeral handoff dir

│ ├── research-customer-{id}.md # skill A output

│ ├── draft-customer-{id}.md # skill B output

│ └── reviewed-draft-customer-{id}.md # skill C output

└── output/

└── customer-health-{id}.pdf # skill D final

یہ ہے بھی کہاں اگلا دو parts کا کورس شروع کریں کو matter. Some skill ہینڈ آفز don't belong on filesystem: they belong میں ریکارڈ کا مستند نظام. "customer health" snapshot سے skill ایک doesn't just فراہم کرنا skill B; یہ کا بھی ایک record کمپنی ضرورت ہے کو رکھیں، کو query later، کو find similar cases کے خلاف، کو audit if customer complains six weeks later. ایک skill کہ writes کو ایک temp فائل ہے ایک draft. ایک skill کہ writes کو ریکارڈ کا مستند نظام ہے ایک action. کہ distinction ہے کیا حصہ 2 builds.

Try کے ساتھ AI

Compare two design approaches for a customer-refund-issuance workflow:

Design A: One big skill called "issue-refund" that handles eligibility check,

policy lookup, amount calculation, gateway call, ticket update, and customer

notification.

Design B: Five small skills (check-refund-eligibility, lookup-refund-policy,

calculate-refund-amount, call-payment-gateway, update-support-ticket,

notify-customer) chained via filesystem handoffs in tmp/.

For each design, name (1) one situation where it's the right choice and

(2) one specific failure mode it's vulnerable to. Then tell me which

design you'd ship and why.

تصورات 1-5 describe کیسے skills should کام جب ماڈل ہے ایک مضبوط instruction-follower (Claude Sonnet/Opus، GPT-5-class، Gemini 2.5 Pro). کے ساتھ ایک smaller یا cheaper ماڈل (deepseek-chat، Haiku-class، Llama-70B، Mistral، زیادہ تر local ماڈلز)، three things drift:

- Multi-skill sequencing. SKILL.md imperatives like "ہمیشہ چلائیں یہ پہلے drafting" یا "call X، پھر Y، پھر Z" land reliably on مضبوط ماڈلز اور unreliably on weaker ones. fix ہے کو شامل کریں ایک short GENERAL-FLOW preamble میں agent کا نظام پرامپٹ spelling باہر order. skill bodies stay declarative; نظام پرامپٹ فراہم کرتا ہے orchestration scaffold.

- Format drift. ایک weaker ماڈل گا silently شامل کریں emojis، markdown tables، "Action Taken" headers، یا paraphrase آپ کا inputs even جب skill body says "نتیجہ بطور five paragraphs، نہیں tables، preserve صارف کا text verbatim." Be زیادہ explicit on ایک weaker ماڈل: list کیا نہیں کو کریں، نہیں just کیا کو کریں.

- trigger blindness. Descriptions کہ fire on "summarize ticket TKT-1042" ہو سکتا ہے miss "کیا کا story on #1042" on ایک smaller ماڈل. لکھیں descriptions کے ساتھ زیادہ concrete trigger phrasings (تصور 3's طریقہ کار matters زیادہ، نہیں کم، جب ماڈل ہے weaker).

قاعدہ کا thumb: بجٹ مضبوط ماڈل کا effort میں SKILL.md، بجٹ weak ماڈل کا effort میں نظام پرامپٹ. fact کہ ڈھانچہ survives یہ drift کے ساتھ extra scaffolding ہے itself ایک vote کے لیے ڈھانچہ: skill/MCP/SoR boundaries ہیں stable; صرف prompting کے گرد انہیں تبدیلیاں.

حصہ 2: Neon Postgres + pgvector بطور ریکارڈ کا مستند نظام

حصہ 1 gave agent صلاحیتیں یہ سکتا ہے load on demand. Those صلاحیتیں ہیں useless بغیر state کو کام کے خلاف: customer history، prior conversations، policy library، audit log. previous کورس's agent kept state میں ایک local SQLite فائل ( سیشن DB) اور stub ڈیٹا میں Python lists. کہ کام کرتا ہے کے لیے ایک demo. یہ doesn't کام کے لیے ایک ورکر کہ has کو جواب "کیا did we tell یہ customer six weeks ago?" یا "رکھتے ہیں we seen یہ سوال پہلے، اور کیا did resolution دیکھیں like?"

یہ Part replaces دونوں کے ساتھ ایک ریکارڈ کا مستند نظام: ڈھانچے سے متعلق اصطلاح سے thesis کے لیے " authoritative store کا state افرادی قوت reads سے اور writes کو." We استعمال کریں Neon Postgres کے ساتھ pgvector extension. ڈھانچہ ہے invariant; Neon ہے پروڈکٹ. Any پائیدار، addressable، governed Postgres satisfies requirement.

First-pass compression note. حصہ 2 ہے densest stretch کا یہ کورس: six tables، SQL، embedding pipelines، vector index math. If آپ کا Postgres ہے rusty، پڑھیں تصورات 6 اور 7 کے لیے shape، پھر سرسری پڑھیں 8–10 اور come back جب آپ تعمیر کریں. minimum-viable ورکر doesn't اصل میں ضرورت all six tables on دن ایک:

messages+embeddingsہے enough کو feel ڈھانچہ کام. شامل کریںdocumentsجب آپ رکھتے ہیں ایک حقیقی library کو embed. شامل کریںaudit_logاورcapability_invocationsپہلا وقت آپ رکھتے ہیں کو جواب "کیا did agent کریں پر 3am last Tuesday?" شامل کریںconversationsجب ایک صارف starts having زیادہ than ایک کا انہیں. six-table schema below ہے کہاں آپ end up، نہیں کہاں آپ شروع کریں.

تصور 6: کیوں managed Postgres، اور کیوں Neon specifically

thesis ہے product-agnostic کے بارے میں ریکارڈ کے مستند نظام: " AI-Native کمپنی کا existing ڈیٹا بیسز، ورک فلو، اور operational پلیٹ فارمز (CRMs، ERPs، ticketing نظام، ڈیٹا warehouses، ledgers) serve بطور ریکارڈ کا مستند نظام." کے لیے ایک agent آپ're تعمیر سے scratch، though، آپ ضرورت کو چنیں something. سوال ہے نہیں "Postgres vs. MongoDB vs. ایک vector DB"; یہ کا "کون سا Postgres."

کیوں Postgres، نہیں ایک dedicated vector ڈیٹا بیس. Three reasons کہ hold even میں 2026.

-

ایک ڈیٹا بیس، ایک transaction، ایک auth boundary. ایک vector DB plus ایک relational DB means دو stores کو رکھیں مستقل، دو auth نظام کو scope، دو backup pipelines کو maintain. pgvector extension puts vectors next to صارف records، ticket records، اور audit logs they're related کو: ایک JOIN ہے ایک JOIN، نہیں ایک network hop درمیان دو eventually-consistent services. ہر major managed Postgres provider (AWS RDS، Google Cloud SQL، Azure، Supabase، Neon) ships pgvector کے ذریعے default; Neon alone رپورٹس 30،000+ ڈیٹا بیسز running یہ. کے لیے زیادہ تر workloads، یہ کا empirical جواب کو "ہے یہ enough." یہ almost ہمیشہ ہے.

-

Postgres پہلے ہی کرتا ہے مشکل parts. Transactions، indexes، foreign keys، row-level سیکیورٹی، point-in-time recovery، query planning. ایک dedicated vector DB has کو invent یہ سے scratch اور usually کرتا ہے some کا انہیں worse. default boring choice has compounding advantages.

-

MCP servers exist کے لیے Postgres پر ہر layer. Neon ships ایک (کے لیے management). عمومی Postgres MCP servers exist (کے لیے SQL عمل درآمد). آپ سکتا ہے لکھیں آپ کا اپنا (کے لیے scoped runtime access). MCP نظام کے گرد Postgres ہے زیادہ تر mature.

کیوں Neon specifically: three differentiators.

-

Serverless کے ساتھ wasیع کرنا-to-zero. Free tier لاگتیں nothing جب idle. ایک ورکر کہ handles 50 conversations per دن spends زیادہ تر کا اس کا وقت لاگت $0، نہیں $50/month کے لیے ایک provisioned instance. Critical کے لیے economics کا ایک multi-Worker AI-Native کمپنی کہاں بہت سے ورکرز ہیں bursty.

-

Branching. ایک Neon ڈیٹا بیس branches میں seconds: ایک مکمل copy-on-write clone کا آپ کا پروڈکشن ڈیٹا، ready کو query. intended استعمال کریں ہے dev/test environments اور migration safety; agent-relevant استعمال کریں ہے letting agent experiment on ایک branch بغیر touching پروڈکشن. ایک migration کہ goes wrong on ایک branch ہے reverted کے ذریعے deleting branch. وہی operation on ایک non-branchable ڈیٹا بیس ہے ایک restore سے backup.

-

First-class MCP integration. Neon ships ایک official MCP server (remote پر

https://mcp.neon.tech/mcp، OAuth-authed) کہ exposes پروجیکٹ management، branch lifecycle، SQL عمل درآمد، اور migration tooling کو any MCP client. We'll استعمال کریں یہ کے لیے development. Critically (اور we'll return کو یہ) Neon explicitly کرتا ہے نہیں recommend Neon MCP server کے لیے پروڈکشن runtime استعمال کریں. یہ کا ایک powerful natural-language interface; پروڈکشن agents talk کو Postgres کے ذریعے narrower، scoped MCP servers آپ لکھیں yourself، یا کے ذریعے direct connections. distinction matters; حصہ 3 بناتا ہے یہ operational.

فوری چیک. Three claims، mark ہر True یا False پہلے مطالعہ اگلا paragraph: (ایک) Neon MCP server ہے intended کو be runtime ڈیٹا بیس connection کے لیے پروڈکشن AI ورکرز. (b) ایک Neon ڈیٹا بیس branched سے پروڈکشن starts کے ساتھ all پروڈکشن ڈیٹا پہلے ہی میں یہ. (c) ایک Neon ڈیٹا بیس کہ hasn't received ایک query میں ایک hour ہے اب بھی لاگت آپ money کے تحت free tier.

جوابات: (ایک) False: Neon's اپنا documentation says MCP server ہے کے لیے development/testing صرف. (b) True: branches ہیں copy-on-write، اس لیے branch starts بطور ایک logical clone کا پروڈکشن کے ساتھ نہیں ڈیٹا movement. (c) False: wasیع کرنا-to-zero means idle ڈیٹا بیسز لاگت nothing on free tier. یہ three جوابات ہیں operational shape کا کیوں Neon fits بطور SoR.

Try کے ساتھ AI

Your customer-support Worker handles EU customers. Your legal team

says: "All customer data must stay in Frankfurt." Neon's free tier

offers US-East regions only; their paid tier offers EU regions.

For each of these three approaches, decide GO or NO-GO and give ONE

sentence of justification:

A) Use Neon's paid tier in an EU region (pay-as-you-go, typically $25–75/month for a single Worker per [Neon's pricing](https://neon.com/pricing)) and ship.

B) Use Postgres on a Frankfurt VPS you manage yourself (no pgvector

MCP server, no branching, no scale-to-zero) and ship.

C) Use Neon's free US tier; embed everything client-side before

sending; tell legal it's "encrypted at rest."

Then say which one you'd actually pick and what you'd ask legal

before committing.

تصور 7: ورکر کا schema، کیا tables ایک agent اصل میں ضرورت ہے

ایک ورکر کا ریکارڈ کا مستند نظام ہے نہیں just "store conversations somewhere." یہ کا ایک structured schema کہ supports four things thesis says ہر ورکر کرتا ہے: پڑھیں truth، لکھیں outcomes، leave traces، find similar prior کام. Six tables cover 90% case. آپ'll شامل کریں زیادہ کے لیے domain specifics; یہ ہیں load-bearing six.

-- 1. CONVERSATIONS: the top-level unit of work

CREATE TABLE conversations (

id UUID PRIMARY KEY DEFAULT gen_random_uuid(),

user_id TEXT NOT NULL,

started_at TIMESTAMPTZ NOT NULL DEFAULT NOW(),

ended_at TIMESTAMPTZ,

metadata JSONB NOT NULL DEFAULT '{}'::jsonb,

-- searchable summary; populated by the agent at conversation end

summary TEXT

);

CREATE INDEX idx_conversations_user ON conversations(user_id, started_at DESC);

-- 2. MESSAGES: the turns of a conversation

CREATE TABLE messages (

id UUID PRIMARY KEY DEFAULT gen_random_uuid(),

conversation_id UUID NOT NULL REFERENCES conversations(id) ON DELETE CASCADE,

role TEXT NOT NULL CHECK (role IN ('user', 'assistant', 'tool', 'system')),

content TEXT NOT NULL,

-- token counts let you reason about cost without re-counting

input_tokens INT,

output_tokens INT,

created_at TIMESTAMPTZ NOT NULL DEFAULT NOW()

);

CREATE INDEX idx_messages_conv ON messages(conversation_id, created_at);

-- 3. DOCUMENTS: the agent's reference library

CREATE TABLE documents (

id UUID PRIMARY KEY DEFAULT gen_random_uuid(),

source TEXT NOT NULL, -- 'policy_library', 'kb_article', 'past_case', etc.

title TEXT NOT NULL,

body TEXT NOT NULL,

metadata JSONB NOT NULL DEFAULT '{}'::jsonb,

created_at TIMESTAMPTZ NOT NULL DEFAULT NOW(),

updated_at TIMESTAMPTZ NOT NULL DEFAULT NOW()

);

CREATE INDEX idx_documents_source ON documents(source);

-- 4. EMBEDDINGS: vector representations of documents AND past conversations

CREATE TABLE embeddings (

id UUID PRIMARY KEY DEFAULT gen_random_uuid(),

-- one of these is populated; the other is NULL

document_id UUID REFERENCES documents(id) ON DELETE CASCADE,

conversation_id UUID REFERENCES conversations(id) ON DELETE CASCADE,

chunk_text TEXT NOT NULL,

chunk_index INT NOT NULL,

embedding VECTOR(1536) NOT NULL,

model TEXT NOT NULL, -- 'text-embedding-3-small', etc.

created_at TIMESTAMPTZ NOT NULL DEFAULT NOW(),

CHECK (

(document_id IS NOT NULL)::int + (conversation_id IS NOT NULL)::int = 1

)

);

-- the load-bearing index for semantic search; see Concept 8

CREATE INDEX idx_embeddings_hnsw

ON embeddings USING hnsw (embedding vector_cosine_ops);

-- 5. AUDIT_LOG: every action the Worker takes, replayable forever

CREATE TABLE audit_log (

id BIGSERIAL PRIMARY KEY,

conversation_id UUID REFERENCES conversations(id) ON DELETE SET NULL,

actor TEXT NOT NULL, -- 'worker:customer-support', 'system', etc.

action TEXT NOT NULL, -- see "canonical action vocabulary" below

target TEXT, -- table name, skill name, etc.

payload JSONB NOT NULL, -- the data of the action

result JSONB, -- what happened

created_at TIMESTAMPTZ NOT NULL DEFAULT NOW()

);

CREATE INDEX idx_audit_conv ON audit_log(conversation_id, created_at);

CREATE INDEX idx_audit_action ON audit_log(action, created_at);

-- 6. CAPABILITY_INVOCATIONS: every skill or tool call, for replay and metrics

CREATE TABLE capability_invocations (

id UUID PRIMARY KEY DEFAULT gen_random_uuid(),

conversation_id UUID NOT NULL REFERENCES conversations(id) ON DELETE CASCADE,

capability TEXT NOT NULL, -- 'skill:summarize-ticket', 'tool:search_docs', etc.

arguments JSONB NOT NULL,

result JSONB,

status TEXT NOT NULL CHECK (status IN ('ok', 'error', 'timeout')),

latency_ms INT,

cost_cents INT, -- approximate cost in 1/100 cents

created_at TIMESTAMPTZ NOT NULL DEFAULT NOW()

);

CREATE INDEX idx_cap_conv ON capability_invocations(conversation_id, created_at);

ایک few notes on ڈیزائن choices، since ہر ہے load-bearing:

-

ایک embeddings table کے لیے دونوں دستاویزات اور conversations. ایک

CHECKconstraint ensures exactly ایک کاdocument_idیاconversation_idہے سیٹ. یہ lets آپ کریں semantic search across "policies اور past conversations" میں ایک query; سوال "رکھتے ہیں we answered یہ پہلے?" gets ایک index، نہیں دو. -

audit_logاستعمال کرتا ہےBIGSERIAL، نہیںUUID. audit rows ہیں لکھا گیا constantly; simpler integer اہم keeps inserts تیز اور ordering trivial. دwasرا tables استعمال کریںUUIDکیونکہ rows leave ڈیٹا بیس (میں API responses، میں URLs) اور UUIDs بچیں leaking row counts. -

capability_invocationsseparates skills سے ٹولز. ایک skill invocation اور ایک@function_toolinvocation ہیں conceptually similar مگر operationally مختلف (مختلف کوڈ paths، مختلف لاگت profiles، مختلف ناکامی طریقے). Storing انہیں میں ایک table کے ساتھ ایکcapabilitydiscriminator lets آپ query دونوں together جب asking "کیا did agent کریں?" جبکہ اب بھی splitting انہیں جب asking "کیا did skills لاگت vs. ٹولز?" -

metadata JSONBcolumns ہیں escape hatches. schema سکتا ہے't predict ہر domain-specific field آپ'll ضرورت; JSONB lets آپ شامل کریں fields بغیر migrations. استعمال کریں sparingly: fields کہ appear میں بہت سے queries چاہیے be promoted کو columns.

یہ ہے minimum operational schema کے لیے ایک ورکر: three tables کے لیے کام (conversations، messages، دستاویزات)، ایک کے لیے embeddings، دو کے لیے trace (audit_log، capability_invocations). آپ'll شامل کریں زیادہ کے لیے domain specifics: ایک customers table، ایک tickets table، ایک policies table کے ساتھ versioning. Those ہیں وہی shape: relational ڈیٹا agent reads اور writes via MCP.

PRIMM، Predict. ایک ورکر handles 200 conversations/day، ہر averaging 10 messages، کے ساتھ 30% triggering ایک skill invocation اور 50% writing دو audit rows beyond skill row. بعد ایک month (30 days)، roughly کیسے بہت سے rows ہیں میں ہر کا six tables? Three options: (ایک) similar volumes across all six (~6،000–60،000 ہر); (b) audit_log dwarfs دwasرے کے ذریعے 10×–50×; (c) embeddings dwarfs everything کیونکہ ہر message gets embedded. Confidence 1–5.

جواب ہے (b): audit_log گا be largest کے ذریعے ایک wide margin کیونکہ ہر interaction پیدا کرتا ہے multiple audit rows: message sent، skill invoked، db لکھیں، db لکھیں again، conversation closed، etc. ایک rough estimate: conversations ~6،000; messages ~60،000; capability_invocations ~1،800; audit_log probably 150،000–300،000. منصوبہ آپ کا retention اور indexing accordingly; audit_log ہے table آپ'll partition پہلا بطور آپ grow.

Try کے ساتھ AI

I want to extend this schema for a customer-support Worker that

handles software bug reports specifically. What three additional

tables would you add, and what columns would they have? For each,

say what the agent will use it for (read access? write access?

both?) and what foreign keys connect it to the six core tables.

تصور 8: pgvector basics، types، distance operators، indexes

embeddings table above ہے کیا بناتا ہے agent کا memory semantically searchable. technology کہ powers یہ ہے pgvector: ایک Postgres extension کہ adds vector ڈیٹا types اور similarity-search operators. یہ ships کے ذریعے default on ہر major managed Postgres provider اور ہے default-choice جواب کے لیے "چاہیے I استعمال کریں ایک separate vector DB?" کے لیے زیادہ تر workloads: نہیں.

** vector type.** VECTOR(n) ہے ایک fixed-length floating-point column. n ہے dimensionality کا آپ کا embeddings: 1536 کے لیے OpenAI's text-embedding-3-small، 3072 کے لیے text-embedding-3-large، varies کے لیے دwasرا ماڈلز. ** dimension لازمی match ماڈل کہ produced embedding.** Mixing dimensions ہے زیادہ تر عام pgvector bug: insert 1536-dim vectors سے ماڈل ایک، query کے ساتھ 1536-dim vectors سے ماڈل B، اور results ہیں nonsense even though ہر query "کام کرتا ہے."

کے لیے dimensions above 2000، HALFVEC type استعمال کرتا ہے half-precision floats اور roughly halves storage پر minor recall لاگت. کے لیے our 1536-dim case، plain VECTOR(1536) ہے fine.

** three distance operators.** pgvector exposes three طریقے کو measure کیسے similar دو vectors ہیں. چنیں ایک کے لیے آپ کا استعمال کریں case اور stick کے ساتھ یہ; mixing ہے ایک recipe کے لیے confusion.

| Operator | Name | کیا یہ measures | جب کو استعمال کریں |

|---|---|---|---|

<-> | L2 distance (Euclidean) | Straight-line distance میں n-dimensional space | Image embeddings، geometric similarity |

<#> | Negative inner پروڈکٹ | Dot پروڈکٹ (negated) | جب آپ کا embedding ماڈل پیدا کرتا ہے un-normalized vectors اور آپ care کے بارے میں magnitude |

<=> | Cosine distance | Angle درمیان vectors، regardless کا magnitude | Text embeddings: default کے لیے our case |

OpenAI's text-embedding-3-small اور text-embedding-3-large پیدا کریں normalized vectors، کون سا means cosine distance اور Euclidean distance دیں equivalent rankings. استعمال کریں cosine distance (<=>) by convention for text embeddings; it's the most common, the most documented, and the index ops are named vector_cosine_ops کے لیے یہ.

ایک semantic-search query، میں مکمل:

-- Find the 5 documents most similar to the user's question

SELECT d.id, d.title, d.body,

e.embedding <=> $1 AS distance

FROM embeddings e

JOIN documents d ON d.id = e.document_id

WHERE e.document_id IS NOT NULL -- excludes conversation embeddings

ORDER BY e.embedding <=> $1 -- smaller distance = more similar

LIMIT 5;

$1 یہاں ہے embedding کا صارف کا سوال، generated پر query وقت. <=> operator ہے کیا بناتا ہے یہ O(n) میں O(log n) دیا گیا درست index.

دو index types: HNSW اور IVFFlat. pgvector has دو عملی index choices. بطور کا 2026، recommendation has converged:

- شروع کریں کے ساتھ HNSW unless آپ رکھتے ہیں ایک وجہ نہیں کو. Graph-based، builds slowly مگر queries تیز، has broadest operator سپورٹ، predictable performance. default کے لیے نیا پروجیکٹس.

- استعمال کریں IVFFlat if تعمیر کریں وقت matters زیادہ than query وقت. Partition-based، builds 5–6× زیادہ تیز than HNSW، queries slower. Useful جب آپ re-تعمیر کریں index frequently یا رکھتے ہیں ایک insert-heavy workload.

- DiskANN موجود ہے (via pgvectorscale extension سے Timescale) کے لیے بہت بڑا indexes کہ don't fit میں RAM. آپ almost certainly don't ضرورت یہ.

HNSW index سے schema above:

CREATE INDEX idx_embeddings_hnsw

ON embeddings USING hnsw (embedding vector_cosine_ops);

دو tuning knobs آپ'll سیٹ if آپ tune پر all: m ( number کا connections per node، default 16) اور ef_construction ( تعمیر کریں-وقت effort، default 64). defaults ہیں sensible کے لیے زیادہ تر workloads; صرف touch انہیں جب آپ've benchmarked.

فوری چیک. Three claims کو mark True یا False. (ایک) آپ سکتا ہے رکھتے ہیں multiple HNSW indexes on وہی

embeddingcolumn، ایک per distance operator. (b) Inserting ایک vector میں ایک table کے ساتھ ایک HNSW index incurs زیادہ لاگت than inserting میں ایک table کے ساتھ نہیں vector index. (c) ایک HNSW index سکتا ہے be بنایا گیا پہلے any ڈیٹا ہے loaded میں table. جوابات: all three ہیں True. Pgvector lets آپ index کے لیے multiple distance operators (rare مگر possible)، index maintenance لاگت ہے حقیقی (کون سا ہے کیوں some workloads prefer batch-insert-then-index)، اور HNSW (unlike IVFFlat) doesn't ضرورت ایک training step.

Try کے ساتھ AI

Two scenarios. For each, pick HNSW or IVFFlat and justify with one

specific property of the index:

Scenario A: A research index of 10M scientific papers. Built once,

queried millions of times. Build time is "whatever it takes —

overnight is fine." Query latency directly affects user experience.

Scenario B: A live index of customer support tickets that's

re-indexed every 4 hours because thousands of new tickets stream in.

Query patterns are simple (top-5 nearest neighbors). The current

HNSW build takes 20 minutes — a third of the re-index cycle.

After you answer: name ONE thing that would change your answer for

each scenario. Be specific about what you'd need to see in

production metrics before switching.

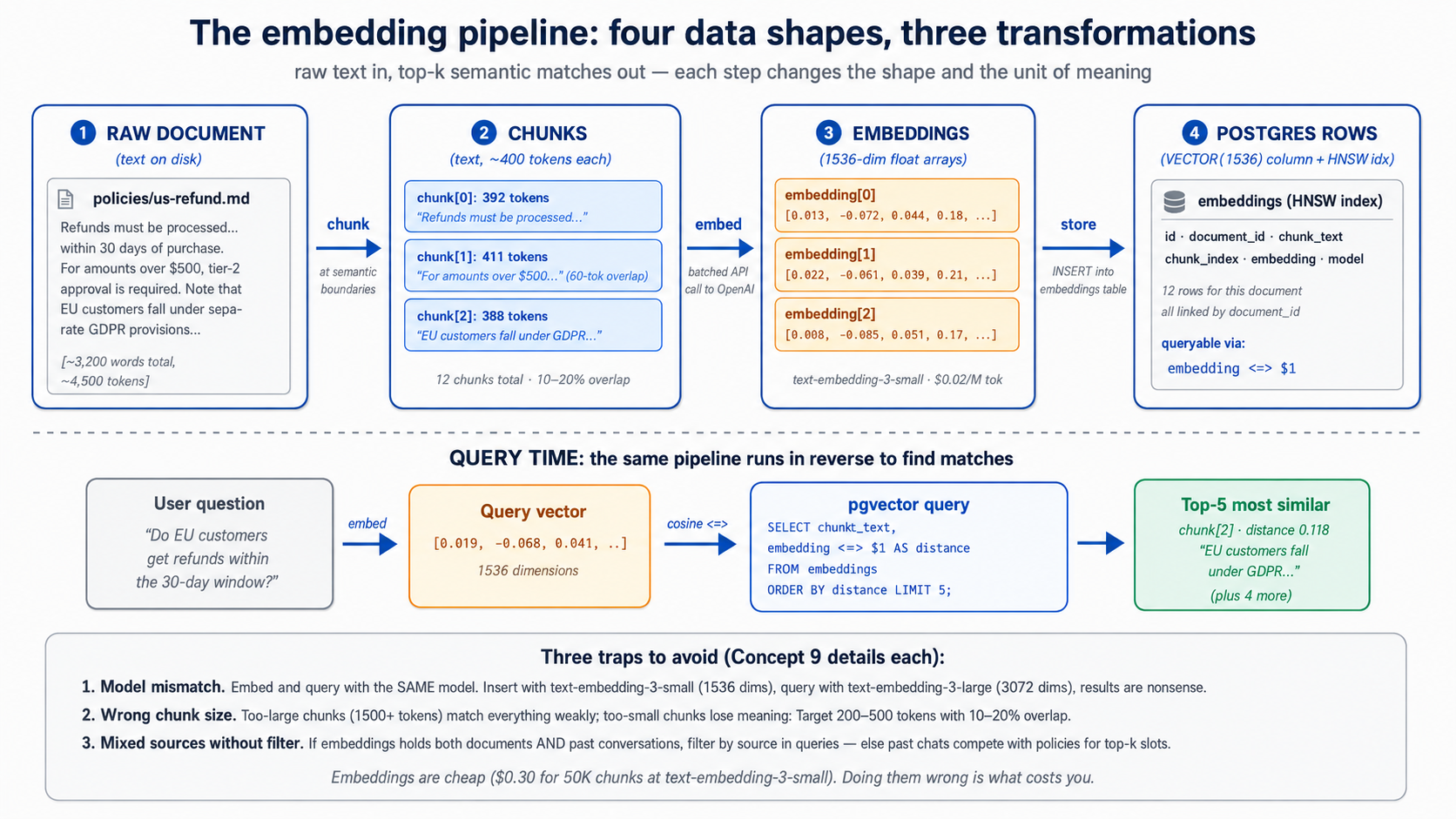

تصور 9: embedding pipeline، text میں، queryable vector باہر

Embeddings don't appear کے ذریعے magic; آپ generate انہیں کے ذریعے calling ایک embedding ماڈل. pipeline ہے straightforward، مگر ہر step has ایک فیصلہ point کہ bites if آپ get یہ wrong.

** four-step pipeline.**

- Chunk دستاویز میں pieces چھوٹا enough کو embed coherently.

- Embed ہر chunk کے ذریعے calling embedding ماڈل.

- Store chunk text، embedding، اور metadata میں

embeddingstable. - Query کے ذریعے embedding صارف کا سوال اور finding nearest neighbors.

Chunking. Embedding ماڈلز رکھتے ہیں token limits: OpenAI's text-embedding-3-small accepts up کو 8،191 tokens per chunk، far زیادہ than آپ typically چاہتے ہیں. سوال isn't "کیا کا maximum" مگر "کیا کا chunk size کہ preserves unit کا meaning صارف گا search کے لیے." Three قواعد کہ کام میں practice:

- Chunk پر semantic boundaries جب آپ سکتا ہے. حصہ headings، paragraph breaks، structural markers میں آپ کا ماخذ. ایک chunk کہ ends mid-sentence retrieves badly.

- Target 200–500 tokens per chunk کے لیے زیادہ تر text. Long enough کو carry meaning، short enough کو be specific. Documents کے ساتھ longer chunks tend کو "match everything weakly" rather than "match درست thing strongly."

- Include 10–20% overlap درمیان chunks کے لیے chunks کہ fall across natural boundaries. overlap لاگتیں storage مگر improves recall جب صارف کا سوال lies near ایک chunk boundary.

- Don't chunk کیا کا پہلے ہی short. Documents پہلے ہی کے تحت ~300 tokens (single resolved tickets، short policy paragraphs، FAQ entries) don't ضرورت chunking; embed انہیں بطور ایک piece. chunker below ہے shaped کے لیے longer ماخذ دستاویزات (policy PDFs، knowledge-base articles، conversation transcripts). کے لیے worked مثال کا seed corpus کا short resolved tickets، آپ سکتا ہے skip chunker اور embed ہر ticket بطور ایک single chunk (فیصلہ 5 stores ہر ticket بطور ایک

documentsrow whosebodyہےsummary || '\n' || resolution، اور embeds کہ).

ایک typed chunking function کے لیے worked مثال:

# src/chat_agent/embedding/chunker.py

from dataclasses import dataclass

@dataclass(frozen=True)

class Chunk:

text: str

index: int

source_offset: int # character offset in the original document

def chunk_text(

text: str,

target_tokens: int = 400,

overlap_tokens: int = 60,

) -> list[Chunk]:

"""Split text into overlapping chunks at paragraph boundaries.

Approximates tokens as words * 0.75 — fine for chunking; not for

actual token counting. Use tiktoken for precise counts.

"""

paragraphs: list[str] = [p.strip() for p in text.split("\n\n") if p.strip()]

target_words: int = int(target_tokens / 0.75)

overlap_words: int = int(overlap_tokens / 0.75)

chunks: list[Chunk] = []

current: list[str] = []

current_word_count: int = 0

source_offset: int = 0

for para in paragraphs:

para_words: int = len(para.split())

if current_word_count + para_words > target_words and current:

chunks.append(Chunk(

text="\n\n".join(current),

index=len(chunks),

source_offset=source_offset,

))

# carry overlap forward

overlap_chunk: list[str] = []

overlap_count: int = 0

for prev in reversed(current):

if overlap_count + len(prev.split()) > overlap_words:

break

overlap_chunk.insert(0, prev)

overlap_count += len(prev.split())

current = overlap_chunk

current_word_count = overlap_count

source_offset += sum(len(p) for p in current) + 2 * len(current)

current.append(para)

current_word_count += para_words

if current:

chunks.append(Chunk(

text="\n\n".join(current),

index=len(chunks),

source_offset=source_offset,

))

return chunks

Embedding. Call ماڈل کے ساتھ batched chunks ( OpenAI API accepts arrays کا inputs میں ایک request، much زیادہ efficient than ایک call per chunk):

# src/chat_agent/embedding/embedder.py

from openai import AsyncOpenAI

EMBEDDING_MODEL: str = "text-embedding-3-small"

EMBEDDING_DIM: int = 1536 # the table column must match

async def embed_chunks(

client: AsyncOpenAI, chunks: list[str],

) -> list[list[float]]:

"""Embed a batch of chunks. Returns one vector per chunk, in order."""

response = await client.embeddings.create(

model=EMBEDDING_MODEL, input=chunks,

)

return [item.embedding for item in response.data]

کہاں کریں embeddings come سے جب آپ کا inference provider isn't OpenAI? یہ ہے ایک حقیقی ڈھانچے سے متعلق fork باب has اس لیے far papered پر. OpenAI ہے صرف major inference provider کہ also ships ایک first-class embeddings API; if آپ're routing inference کے ذریعے DeepSeek، Anthropic، Gemini، یا ایک local ماڈل، آپ رکھتے ہیں four options. چنیں ایک پہلے آپ touch VECTOR(n) column، کیونکہ column dimension لازمی match ماڈل.

| ماڈل | Dimensions | Cost (input، per 1M tokens) | کہاں یہ lives | جب کو استعمال کریں |

|---|---|---|---|---|

text-embedding-3-small | 1536 | $0.02 | OpenAI (اور OpenAI-compatible aggregators like OpenRouter) | ** default if آپ رکھتے ہیں ایک OpenAI اہم.** سستا، تیز، اچھا کے لیے زیادہ تر retrieval. |

text-embedding-3-large | 3072 | $0.13 (ماڈل card) / $0.065 (قیمتوں کا تعین صفحہ) | OpenAI | جب آپ've measured -small underperforming. |

embed-english-v3 / embed-multilingual-v3 | 1024 | $0.10 | Cohere | جب آپ're پہلے ہی on Cohere کے لیے inference، یا جب multilingual recall matters. |

voyage-3 / voyage-3-lite | 1024 | $0.06 / $0.02 | Voyage | Embeddings-as-a-service; integrates cleanly کے ساتھ Anthropic-shaped stacks. |

all-MiniLM-L6-v2 / bge-small-en-v1.5 (local) | 384 / 384 | "free" (آپ کا compute) | sentence-transformers package; چلتا ہے CPU-only کے ساتھ نہیں API call | جب آپ کا inference provider has نہیں embeddings API (DeepSeek، زیادہ تر local LLMs)، یا جب ڈیٹا residency forbids sending text کو ایک third party. |

headline لاگت number: embedding 50،000 chunks پر ~300 tokens ہر = 15M tokens × $0.02/M = $0.30 on OpenAI. وہی کے ساتھ -large ہے $1.95. کے ساتھ ایک local 384-dim ماڈل، $0 plus 30 seconds کا CPU. Embeddings ہیں cheapest سطر on bill; choice rarely moves dollar dial، مگر یہ کرتا ہے move ڈھانچہ.

** dimension ہے contract.** VECTOR(1536) صرف accepts 1536-dim vectors. If آپ switch سے text-embedding-3-small (1536) کو all-MiniLM-L6-v2 (384)، آپ re-create column بطور VECTOR(384) اور re-embed ہر row. وہاں ہے نہیں "fits if close enough" کے ساتھ pgvector; dimensions ہیں absolute.

Re-embedding. جب کریں آپ re-embed? Three triggers:

- ** ماخذ دستاویز changed.** Delete اور re-insert all embeddings whose

document_idmatches. - ** embedding ماڈل changed.** migration کا ایک lifetime; if آپ switch سے

-smallکو-large، ہر existing embedding ہے incompatible کے ساتھ نیا ones. Re-embed everything، یا چلائیں دو embedding columns during ایک transition. - ** chunking حکمت عملی changed.** If آپ decide 400 tokens was wrong اور 250 ہے درست، re-chunk اور re-embed. Versioning آپ کا chunks (storing

chunk_strategy_versionمیںmetadataJSONB) lets آپ کریں یہ safely.

PRIMM، Predict. آپ've embedded 100،000 chunks کے ساتھ

text-embedding-3-small. آپ پھر decide کو بھی embed all messages (نہیں just دستاویزات) اس لیے agent سکتا ہے کریں "رکھتے ہیں we discussed یہ پہلے?" lookups. آپ لکھیں message embeddings میں وہیembeddingstable کے ساتھ وہی column. ایک semantic search query (find 5 nearest neighbors کو ایک صارف سوال، نہیں filter) آتا ہے back کے ساتھ mixed دستاویز اور message results. ہے یہ کیا آپ wanted? کیا کا درست query shape? Confidence 1–5.

جواب: almost certainly نہیں کیا آپ wanted. Mixing دستاویزات اور messages میں retrieval results بغیر distinguishing انہیں پیدا کرتا ہے incoherent جوابات: ماڈل sees ایک top result کہ کا ایک customer کا prior message اور treats یہ بطور authoritative documentation. درست نمونہ ہے کو filter کے ذریعے ماخذ type میں query: either کے ذریعے joining اور filtering on WHERE document_id IS NOT NULL کے لیے دستاویز search، یا کے ذریعے running دو separate searches اور ranking انہیں differently. schema کا CHECK constraint کہ exactly ایک کا document_id/conversation_id ہے سیٹ بناتا ہے یہ filter سستا اور intent explicit.

Debugging poor retrieval. جب top-k results don't match expectations، four checks میں order، ہر ruling باہر ایک عام cause:

| Symptom | Likely cause | Fix |

|---|---|---|

| All top-5 distances ہیں > 0.7 (cosine distance، اس لیے کوئی بھی چیز > 0.5 ہے "far") | Query embedding ماڈل differs سے corpus embedding ماڈل | Confirm دونوں went کے ذریعے وہی EMBEDDING_MODEL. Mixing text-embedding-3-small کے ساتھ -large، یا local کے ساتھ OpenAI، پیدا کرتا ہے nonsense ranks across دونوں pools. |

| Top-5 results ہیں all سے ایک ماخذ type جب آپ expected variety | ماخذ-type filter missing | شامل کریں WHERE document_id IS NOT NULL (یا درست side کا CHECK constraint) کو query، یا split میں دو ranked queries اور merge انہیں کے ساتھ explicit weights. |

| Top-k تبدیلیاں wildly درمیان near-identical queries | Chunk size too چھوٹا (ہر chunk lacks enough سیاق و سباق) | Re-chunk کے ساتھ بڑا chunks (200، پھر 400، پھر 600 tokens) اور re-embed. Re-running وہی query چاہیے اب پیدا کریں stable top-k. |

| Query returns nothing | HNSW index missing، یا vector dimension mismatch | \d+ embeddings میں psql کو confirm column ہے VECTOR(1536) اور HNSW index موجود ہے کے ساتھ vector_cosine_ops. If column ہے wrong dimensionality، re-create یہ. |

Three diagnostic queries worth keeping میں ایک scratch.sql:

-- 1. Distance band on the top-5 for a known-good query

SELECT chunk_text, embedding <=> :query_vec AS distance

FROM embeddings ORDER BY distance LIMIT 5;

-- 2. Source-type breakdown of top-20 (catch the "wrong source dominates" bug)

SELECT

CASE WHEN document_id IS NOT NULL THEN 'document' ELSE 'message' END AS src,

COUNT(*)

FROM (SELECT * FROM embeddings ORDER BY embedding <=> :query_vec LIMIT 20) t

GROUP BY src;

-- 3. Confirm the index is actually being used

EXPLAIN (FORMAT TEXT) SELECT id FROM embeddings ORDER BY embedding <=> :query_vec LIMIT 10;

Retrieval quality ہے silent killer کا ورکر accuracy. final جواب سکتا ہے sound perfectly reasonable جبکہ citing wrong evidence; صرف طریقہ کو catch یہ ہے کو جانچیں retrieval پہلے final جواب.

Try کے ساتھ AI

I'm chunking a corpus of legal contracts (each averaging 8,000 words)

for semantic search. The user will query things like "what's the

termination clause in this contract" — phrases that map cleanly to

specific sections. Walk me through three chunking strategies:

A) Fixed 400-token chunks with 60-token overlap (the default)

B) Chunk at section headings only, with no overlap

C) A two-level approach: store both 400-token chunks AND

whole-section chunks, search both, combine results

For each, name (1) when it wins and (2) when it loses.

تصور 10: audit trail بطور طریقہ کار، کیا "reads اور writes" means کے لیے ایک ورکر

thesis ہے unusually direct کے بارے میں یہ: "ہر action ایک ورکر لیتا ہے leaves ایک trace میں ایک store کہ survives agent کا سیشن اور سکتا ہے be inspected، replayed، اور trusted. ریکارڈ کا مستند نظام ہے کیا separates عمل درآمد سے plausible-sounding fiction. یہ ہے بھی کیا بناتا ہے افرادی قوت legible بعد fact."

Translated کو operational اصطلاحات: ہر meaningful action agent لیتا ہے writes ایک row کو audit_log، plus ایک زیادہ structured row کو capability_invocations if یہ کا ایک skill یا ٹول call. ڈیٹا being acted on lives میں اس کا appropriate table (ایک message goes میں messages، ایک دستاویز update goes میں documents); fact کہ action happened lives میں audit_log. دو ہیں joined کے ذریعے foreign اہم.

کیا کو log.

- ہر ماڈل call: input tokens، نتیجہ tokens، ماڈل name، لاگت estimate

- ہر skill invocation: skill name، arguments، result summary، latency، success/error/timeout

- ہر ڈیٹا بیس لکھیں: کون سا table، کیا changed ( JSONB payload)، کے تحت کون سا conversation سیاق و سباق

- ہر external ٹول call: ٹول name، input، نتیجہ summary، latency

- ہر حفاظتی حد event: کون سا حفاظتی حد tripped، کیا input was، کیا action was (blocked/allowed/modified)

کیا نہیں کو log.

- مکمل conversation history on ہر turn; کہ کا پہلے ہی میں

messages، آپ'd be storing یہ twice - sensitive payload ڈیٹا verbatim if row ہے queryable کو humans; store ایک hash یا summary، رکھیں مکمل ڈیٹا میں ایک restricted table

- Internal ماڈل استدلال کہ صارف shouldn't دیکھیں; کہ کا ایک سیاق و سباق-management فیصلہ، نہیں ایک audit فیصلہ

** replay test.** ایک اچھا جانچ کا ریکارڈ passes ایک specific test: دیا گیا ایک conversation_id اور ایک timestamp، آپ سکتا ہے reconstruct کیا agent did اور کیوں، بغیر re-running ماڈل. If آپ کا audit log doesn't pass یہ test، یہ کا logging، نہیں auditing.

ایک concrete write-on-action helper، استعمال ہوا everywhere ایک صلاحیت چلتا ہے:

# src/chat_agent/audit.py

import time

import json

from typing import Any

from uuid import UUID

import asyncpg

async def log_capability(

pool: asyncpg.Pool,

conversation_id: UUID,

capability: str,

arguments: dict[str, Any],

result: Any,

status: str,

started_at: float,

cost_cents: int | None = None,

) -> None:

"""Write a capability_invocations row plus a denormalized audit_log row.

Both writes happen in one transaction so they're either both present

or both absent — the audit trail never gets partial.

"""

latency_ms: int = int((time.monotonic() - started_at) * 1000)

async with pool.acquire() as conn:

async with conn.transaction():

await conn.execute(

"""INSERT INTO capability_invocations

(conversation_id, capability, arguments, result, status,

latency_ms, cost_cents)

VALUES ($1, $2, $3::jsonb, $4::jsonb, $5, $6, $7)""",

conversation_id, capability,

json.dumps(arguments), json.dumps(result),

status, latency_ms, cost_cents,

)

await conn.execute(

"""INSERT INTO audit_log

(conversation_id, actor, action, target, payload, result)

VALUES ($1, $2, $3, $4, $5::jsonb, $6::jsonb)""",

conversation_id, "worker:customer-support",

"capability_invoked", capability,

json.dumps({"arguments": arguments, "latency_ms": latency_ms}),

json.dumps({"status": status, "result": result}),

)

دو writes میں ایک transaction ہے load-bearing detail. Half-written جانچ کا ریکارڈs ہیں worse than missing جانچ کا ریکارڈs: they suggest completeness بغیر delivering یہ. Either دونوں rows جائیں میں یا neither کرتا ہے.

مستند action vocabulary. ہر site کہ writes کو audit_log picks ایک action قدر سے ایک چھوٹا، agreed list. Drift یہاں ( وہی event gets called three مختلف names across codebase) ہے کیا بناتا ہے replay queries fragile six months later. six values worked مثال استعمال کرتا ہے، اور کون سا کوڈ path writes ہر:

action | target | کہاں لکھا گیا |

|---|---|---|

message_received | (null) | cli.py، جب صارف sends ایک message اور ایک row lands میں messages |

message_sent | (null) | cli.py، جب agent کا reply lands میں messages |

skill_activated | skill name | cli.py، on RunItemStreamEvent کے لیے ایک skill load |

capability_invoked | صلاحیت id | log_capability helper above، on ہر skill یا MCP-ٹول call |

mcp_called | ٹول name | cli.py، بعد ہر MCP ٹول returns (lower-level than capability_invoked; استعمال کریں ایک یا دwasرا consistently) |

refund_issued / refund_blocked | order id | customer-data MCP server کا issue_refund ٹول، on success اور policy denial |

چنیں ایک کا capability_invoked اور mcp_called اور stick کے ساتھ یہ; writing دونوں per call double-counts. worked مثال استعمال کرتا ہے capability_invoked کے لیے agent-side helper (فیصلہ 7) اور named domain actions like refund_issued کے لیے state-changing writes اندر MCP ٹولز (فیصلہ 6). Domain-state writes ہمیشہ get ان کا اپنا action name اس لیے audit row ہے receipt کے لیے کاروباری event، نہیں just کے لیے ٹول call کہ triggered یہ.

کیوں یہ isn't just logging. Three properties separate audit ڈیٹا سے log ڈیٹا:

- Replayable. schema lets آپ reconstruct agent کا استدلال trace سے

audit_logjoined کے ساتھmessagesjoined کے ساتھcapability_invocations. ایک log سطر میں ایک JSONL فائل doesn't. - Queryable. "کیا did agent tell customer X last month، اور کون سا policy did یہ cite?" ہے ایک SQL query. "کون سا skill triggered زیادہ تر timeouts میں last 7 days?" ہے ایک SQL query. Logs require grep اور luck.

- Trustworthy. audit rows ہیں میں وہی ڈیٹا بیس بطور کاروباری ڈیٹا. They're backed up together، point-in-time-recoverable together، access-controlled together. They survive agent عمل، ڈیپلائمنٹ region، اور ماڈل نسخہ.

یہ ہے کیا thesis means جب یہ says "ورکرز صرف بن جاتے ہیں governable بطور ایک افرادی قوت جب ایک ledger بناتا ہے انہیں legible، بطور units کا صلاحیت، لاگت، latency، اور نتیجہ." آپ کا audit_log اور capability_invocations tables are کہ ledger. Treat انہیں like ایک.

Try کے ساتھ AI

Here's a customer support scenario: a customer claims the Worker told

them they would receive a $50 refund, but the actual refund issued was